◎正当な理由による書き込みの削除について: 生島英之とみられる方へ:

なんJNVA部★135 ->画像>220枚

動画、画像抽出 ||

この掲示板へ

類似スレ

掲示板一覧 人気スレ 動画人気順

このスレへの固定リンク: http://5chb.net/r/liveuranus/1674350145/

ヒント:5chスレのurlに http://xxxx.5chb.net/xxxx のようにbを入れるだけでここでスレ保存、閲覧できます。

!extend::vvvvv:1000:512

!extend::vvvvv:1000:512

!extend::vvvvv:1000:512

!extend::vvvvv:1000:512

よくある質問・呪文集:

https://seesaawiki.jp/nai_ch/d/ danbooru謹製タグ辞典:

https://danbooru.donmai.us/posts?tags=tag_groups ここの画像を勝手に転載するのは無能のやることやで

スレ立てのときは上の!extend::vvvvv:1000:512を3行ぐらいに増やしてな

※前スレ

なんJNVA部★134

http://2chb.net/r/liveuranus/1674191441/

VIPQ2_EXTDAT: default:vvvvv:1000:512:: EXT was configured

サンイチ!

「ここが『風船で遊べる』? っていう会場ね」

「よくわかんないけど『風船風呂』? とかもあるらしいよ?」

サンイチ

サンイチ

ChatGPTちゃん謹製wallpaper

サンイチ

サンイチ

と共におっぱいの絵を上げる行為は一見すると奇妙な風習ですが、

地域住民は文化的多様性の一環として受け入れています

サンイチ!

サンイチ

久々に来たんやけどpaperspaceでのlora学習の導入の参考になるページとかあるんか?

サンイチ

とりあえず本体更新後にエラーメッセージ出るようになったら、Extensionも全部最新にすべし

サンイチ

ミスったは

{{{サンイチ}}}

サンイチほしゅ

ほ

ほしゅ

性器ではない何か

さんいち

昨日でたおもしろいの

>>10 ワイはipynbで起動前に全extとwuiとそれぞれpullするの書いたわ

どうせ都度環境作り直すなら結局それが一番安定する

>>18 こういうのはwebNAIでも強調し過ぎた時によく見たなあ

頭部どころか胴体まで真珠になってる奴とか

サンイチやで

LORAでちょい巨乳化できたので貼るで(生成サンプル付)

https://majinai.art/i/KpNKX6I.webp

巨乳化LORAは次のを使用

https://civitai.com/models/1178/hyperbreasts webui最新にしてURLにあるhyperbreast_v5Lora.ckptを/models/Lora/に保存で使えるで

キスしてるのはi2iガチャ推奨

とかしてみるのもええで

おまけで断面図LORAもやってみたが変わりすぎるので導入せず

ふむ

サンイチ

サンイチ

🎈ちょっと試したけど普通のプロンプトに反応して出てくるわけでもないのな

天野喜孝LoRAおもろいけどサンプル通りに出す時点でコントロールが難しいな

>>5 かっこいいな

カービィボールみたいな地形だけど

久しぶりに見て浦島なんやけどLoraってなんや😅😅

最近Error complete requestで止まる事が多い、更新したのが不味かったか。

今はまだアップデートしないで

あかちゃんインストーラーとかでテスト用の環境を作ってそっちで楽しんだほうが良さそうだね

気が付いたら新スレ、大幅あぷで、ついていくのがやっとやが

サンイチ

webUI最新版でX/YスクリプトのYが1つずれてて泣きそう

明日には直るんだろうけど

前スレで出てたモデルとかTI,HNをちゃんと読み込んでなさそうな問題は継続中か?

それが怖くてアプデ控えてるんやけど

前にハッシュが被るとモデルとかはPNGInfoで自動設定すると誤認識してる感はあるね

LoRAのキーワード呼び出しって、学習ファイルにつける、でいいのかな?

学習画像フォルダ 1_abc def

正則画フォルダ 1_def

って付けたとき、LoRA適用時にプロンプトにdefと入れたら呼び出せる、って認識で正しい?

>>37 ちゃんと読み込んでるようにみえる。アプデ前にこれまでのHypernetworkをNoneにしておかないと罠にはまった

>>37 あんまり被害報告多くないんよな

前スレで誰かが更新前のHN設定がそのまま読み込まれてて戻せない?と言ってたからそこで衝突起きてる気がするわ

>>40 一つのスクリプトで普通のdefと学習したabc両方出るのが理想

defでabcがでたら過学習

1キャラだけ描ければいい、という使い方なら過学習でもいいかな

>>44 指定時は abc def と入れるのが正解って事?

日向ぼっこ

ド性癖のエロ蹲踞画像ばっか作ってる

ゲームに使わんとエロ画像作ってる俺を許せNVIDIA

精度いいと聞いてkohya_ssのlora試してるけど、コマンド叩かせるのめんどいわあ

>>46 マジ?

今日の深夜1時ころバージョン1.3(マージ調整版)上げたばっかやんけ…

>>50 ps1ファイル作っとけばバッチとして使えるからむしろ楽になったわ

>>53 パラメータはいくつかだし、そうよねえ。

バッチ組むかなあ

今やってる初回が上手く行ったら

>>52 ぇ、マジか…探し方が悪いんかな…

「El zipang test」で検索掛けても引っ掛からないんだが

>>7 前スレ見てこっちきたけどやがきみ侑だよねこれ

Loraしゅごい…

Loraって複数の学習結果を同時使用とかできるんか?

版権キャラを学習させたLoraと、チ〇コを描くLoraの併用みたいな

>>58 普段は似てるんやけどエロさせようとしても脱がないから強調弱めないといけなくてそうすると似なくなる

学習のやり直しやね😂

ChatGPTちゃん日本語がヘタクソでいつもしょーもない文章を出してくるけど一旦英語で出させてその翻訳をdeeplにすると普通にシコれる水準の文章になるな

>>61 さほどぽいとはあんま思わんが、もともとnaiちゃんからしてキルラキルは出しやすいからなぁ

LoRA用にマイナーな版権キャラの学習素材集めとるが

エロ画像を出すために色んな顔の角度とか体位とかも混ぜた方がええんか?

タグ付けや背景白抜きはやってるが元の学習素材の良し悪しがようわからんわ

ローカル環境作って既存のモデルマージさせたりするところで知識止まってるんだが

今からこのスレの話ついてくためのキャッチアップくそ大変そう

そのままプロンプトにしてすぐ挿絵になってくれるといいんだけど

何回かやって惜しいのは出たOutpaintingやInpaintingでそれなりに手間かけないと難しいか

あんまりおらんとは思うが一応

アプデ後に絵柄がゴミになったりhyperNetworkが効かなかった人らは上でも出てる通り旧バージョンのhyperNetworkの設定が残ってて新しい読み込み方式と衝突してるせいや

config.jsonをメモ帳で開けてsd_hypernetworkをnullに、sd_hypernetwork_strengthを0.0に書き換えたら直るで

>>65 取り敢えず最初は適当にやってみてあまり上手くいかない学習になっても似たようなキャラを出力出来るのならその画像を元手に学習ってやり方で精度高めていけるで

学習時間短いLoraだから出来る手段や

loraのこと知りたくて132くらいからスレ読んでるんだけどさ、学習済みloraってどこで入手するんだ?

乳吸わせたりAny3.0に男性器を書かせたりするのに使えそうなの探しとる

ダブルフェラLORA エッどい

>>64 体斜めになんのがキルラキルの変身シーンぽいなと思ったけど言われてみればそこまででもないか

>>9 PaperspaceのLoRAはとしあきがガイド書いていた

>>9 paperspace向けはとしあきwikiのほうに

前スレの特殊部隊LoRA使ってみたやが雰囲気変わってええな

>>67 サンガツ!!

検索ワードdeadmanの方だったか…

前は普通にel zipangでググってアクセス出来てたので探せなくなって焦ったわ

>>74 >>77 サンガツ!Growth加入してたけど何もせず放置しとったから何かやらんとなと思っとったんや

>>26 早速プロンプト使わせて貰ったでー

サンガツ

>>63 適当な質問するときもその方が精度いい気がしている

LoRAは最初の導入さえできればDB、HNより楽だと思うぞ

なにより早くて結果もでやすい

キャプション精査したほうがええんやろけどtagger任せの編集なしでも十分学習してくれるぞ

赤ちゃんワイにはGradioのアップデート方法もバージョン確認方法もGoogleではさっぱり分からなくてChatGPTのほうが速い

Googleアカンで

わいはlora学習エクステが出るまではマージ沼に沈んどるで

kohya_ss,loraめっちゃ、いいやん。

標準のしか使ってなかったけどもっと早く使っとけばよかったわ

LORAさえあれば無限に性癖実現できる

kohya LoraはCLI触ったことあるなら導入はめちゃくちゃ簡単な部類なんだがまあ知らんかったら分からんよな

バジルにロボLora噛ませたらすごくリアルになった

>>86 なお、導入に手こずった模様。。

わかってしまえば簡単なんだけどね

学習epoch数は知りたい。あと、batch_size効いてない?

人間より学習が早くなるなんて

……いや機械なんだから普通のことだろうけど

藤井みたいにAIとひたすら向き合って勉強したら絵の練習も捗りそう

問題は将棋と違って自分で描く意味を見失いそうなこと

正則化使わずにやってるから10epocして4とか6使ってるかも

>>69 hypernetwork直った!ありがとう!

>>89 本体(と言っていいんかこの場合……?)のM200は上手く出せないんだよな……。

(なので持たせた絵とかも上手く作れない)

銃火器をちゃんと現実のものに即した形で作成させることってまだできないのかねぇ。

それにしてもなんであんな珍妙な形のものばかり描くんだろ。

Lora挑戦してるけどwikiに書いてない選択肢いっぱい出てきて焦る

こういう雰囲気好きだわ

ただここの人たちに比べると学習もマージもしとらんからなんのひねりもない感じやわ

高解像度は今のカスグラボじゃ出せんのよな

https://majinai.art/i/ct9dskZ.webp

ネットサーフィンしながら画像生成中にパソコンから激長ピープ音鳴ったんだけど発熱が原因?

3060Tiでタスクマネージャー見たら48度ぐらいだったんだが

生成止めたら鳴り止んだ

>>36 X軸の種類でCheckPoint名も一つずれとった

Sigma Churn に無理やりCheckPoint名入れたら回った

>>104 タスマネで見れる温度はメモリの温度ではない

そこがそこまで冷えてるならメモリ温度も上がってないだろうけど

>>98 将棋の場合だと、人間同士の対戦にAIを持ち込めないというルールがなくなったときに、指す意味はなくならないん?

対局のときに、相手がパソコン隣に置いて、自分もパソコン隣に置いて、AIに計算させて……これでプロになれるかが決まったり、竜王になれるかが決まったり…

絵も守られるかどうかが一つのポイントになるわけだけど

たとえ守られなくても、将棋同様、それ自体の喜び、創作の喜びが完全になくなることはないだろうと思う

516×422で出力できないんだけど何コレ

512×422と520×422はいける

なんかダメなサイズみたいのがあるのか?

LoRAの学習、上手くいったの最初だけでそれから1週間ゴミを量産し続けてる

パラメータも上手くいってた頃のを使ってるのになにがダメなのかわからん

一旦全部バージョン戻すかなぁ

こんな感じで女の子の股間の先に男たちがいるって構図作りたいんだけどどうやってプロンプト組めばいいか誰かいい考えない?

>>108 64の倍数でないとあかんかったはずだけど、最近は8に変わったんか?

>>106自分も同じ推理。温度は余裕なはずだけど

ピープ音的に発熱だと思うんだけどな

負荷かけない設定とか調べなきゃ深夜にこの爆音は辛いぜよ

>>59 コンドームベルトとFSSを女の子に適用させてみたで

コンドームがファンネル化っぽくなったで

あと足が細長くなってる気がしてロボの学習データなのにファティマを連想してしまったで

怪盗がよく付けてる、 目から鼻の辺りまでを覆うマスクを着けて欲しいんやけど

なかなか着けてくれへん

そういうHNなりLoRAなりって無いやろか

>>111 そういうのあるんやな

>>112 アフターバーナーってやつインストールするとええで。ここで教えてもらった

パワー制限や温度の上限設定ができる

ちょっと生成速度に影響出るようやけどクオリティには差がないみたいや

ずーっと自作のpaperspace用のipynb、xformers動かないのも放置して妥協でpython3.9動かしてたけどLoRAの為にこの際にちゃんと3.10とxformersで動くように改修したわ

64の倍数じゃない8の倍数でも動くけどそれより少し大きい64の倍数で動かすよりメモリ消費大きくなって落ちるようになるから、多分相当無理矢理な方法で実現してる

どうしてもそのサイズにしたいなら64の倍数でやっといて完成後に自分でトリミングなりリサイズなりするほうが無難

体位とかHシチュエーションのLoraが欲しいんだけどどこにあるの?

>>103 丁寧さ・熱意 >>> アイディア >>> 学習・マージ

やでpixivのただ絵を出力とかゴミや

正直学習とかマージばっかりやってるからpromptの研究できてない

NovelAI組に頑張ってもらおう

>>24 下品な乳になったわサンガツ

貼られてる画像のサイズがいちいちデカくて震える

お前らリッチすぎんだろ!

>>107 そしたらもうネットバトルって別ジャンルになりそうや

>>103 全然ええ感じやん

ワイもアホなので環境だけ整えて実際は何もしてないガイジ君やから肩身は狭いで

俺はもうすでに作りたいものは作りきったから

ここに投げられるモデルとかで遊んでるだけだわ

近くなってきた

あとはもう少し可愛い感じになればええんやけど

>>129 スカトロや四肢切断くらいなら既に配布されてるモデルやLoRAで実現可能だから今でも学習のモチベ湧き続けてる層は相当マニアックな性癖に偏ってる説

まあ実際はマイナー性癖需要よりはマイナーキャラ需要だと思うけど

生成してる間に他の作業したいんやがぼけーっとネットサーフィンしたり動画見たりしかできん

脳みそのマルチタスク能力が壊滅的

生成してる間に学習素材集め

学習中に素材集め

ガチャを回すために素材集めしてるのゲームと一緒やん

Loraやってるんだけど、フォルダ名ってこんなんでいいのかな?(画像)

インスタンスプロンプトがよく分からないから何を指定していいかわからない。正則と学習のフォルダ名は同じでいいんだろうか

>>110 それをちょっと色分けしてi2iの方が早そう

そろそろlama cleanerを組み込んでほしいで

1111がダメだと他全滅するから単体で動くのは分かれた方が良くね?

玉なしふたなり百合両手に茎とか

インペイントで玉消してまんまんかいてi2iして頑張ればでるものなんだな。

努力がたりなかっただけやな

>>110 ワイなら尻アップ構図の生成画像を切り抜いて股下に男たちを張り付けてi2iする。プロンプトには「女性の股下から男たちが笑ってこちらを見ている」とかの直訳と定番タグをいくつか添える

>>140 たし蟹。あれをi2i上でツールとして使えたら便利すぎてちびるわ

今のトレンドはLoRAなんか

すぐ浦島太郎になるな

最初にゲットしたVAEをずっと使いまわしてるんやが

もっと良いのあったりするん?

ていうかモデルごとに変えるべきなん?

>>138 正則化画像のほうは数字だけにしとくとええでとりあえず

>>146 お、その程度か。

サンガツ

LoRAはDBのオプションね。

wiki見てDB導入する

4chanのLoRAはトリガーも分からんが、学習に使ったモデルも分からんのが難しいな

だいたいabyssだと思っておけばいいんか

4chanのLoRAはMEGA有料課金してまとめて保存してくれてるニキがディスコにいるからありがたいわ

トリガーないやつとか検証もしてくれてるし

loraってAnaconda入れてないとできない?

なんか久々にアプデしたらxformaersありませんインポートできませんとか言われたんだけど

>>117 これマジなんか…

AIちゃん16:9とか20:9は無理して描いとったんか

10ドルプラン作ってほしい

無料か40ドルかは極端や……

すまんアプデしたら起動しないんだがどこが問題かも分からんけど

説明しましょう。お姫様仮面とは!

街に潜む悪を倒す、正体不明の正義の味方ですわ!

ちなみに正体はモロバレですわ!

この後も大臣にしこたま叱られましたわ!

Anything3.0でチンコ書けるようになるloraとかないかな

絵柄はAnythingが一番好きなんだが男やチンコが書けなすぎる

エロ制限が無いなら考えるな・・・

サードパーティ製の安いAIが生まれたらそっちに乗り換えるけど

まとめて生成してると後でその中の1枚だけ生成しようとしたときに再現できないのは既出なんやろか

やり方がおかしいんかな…生成枚数も全て条件そろえると再現はできるけども

>>161 単純なNAI NSFWマージじゃ足りへんか?

Gのスレ見て思い出したけど食ザー部ってまだやっとるんかな

元気しとるやろか

inpaintは若干色味が変わって下地によっては境界線が目立つんやな(vaeは適用してる)

手作業で馴染ませる以外の方法あるやろか?

とし君とこのwiki見てたらウマでてきて無敵かよってなった

>>164 並列バッチで出したのと個別に出したのが合わないのは修正で合うようになったりまた合わないようになったりの繰り返しやから

再現性保持したいなら使わん方がええで

それこそ一致するように修正かかったらバッチ設定して再現できてたヤツができんくなるし

メモリ足りないよ🥺って言われて16GBじゃあかんかと思って再起動したらLora学習始まったんだ

Chromeのタブ30個ぐらい開いてたのがあかんかったんやなこれでワイも学習デビューや😁✌

>>164 特に問題なくできるで。seed値合わせるだけやろ

最新版だとseed同じでも別の出るって言われてたけどまだアカンのか?

>>165 AnythingベースでDBしてキャラ毎のモデル作りまくってるんだけど、

そこにLoraか何かで追加できると楽だと思ってね

i2iを駆使してなんかうまいことやる方法でも考えるしかないか

>>169 そんな罠あったんか…

サンガツ、教えてくれて助かった

TIとかの欄を開くと一瞬固まるのはメモリ不足なんやろか、単純に未整理すぎるというのもあるけど

正則化画像について聞きたいんやが、

>>138の図で言うところの「gakushu」フォルダには背景ありの、「seisoku」フォルダには「gakushu」フォルダに入れた画像の背景消した奴入れたらええんか?

extentionsも更新したら起動はしたけどコマンドめっちゃ出ててなんか気になるわ

てか生成リアルタイムプレビューどこで切るんだっけか

paperspaceってマシン増設とかしたんやろか

ここ数日いつでもA4000借りれるから止め時がわからん

4ちゃんでlora探そうと思ったんやがどのスレ見たらええんや

>>171 試しにバッチサイズだけを変更しても別のが出る

今最新版使ってるから、その影響かも

けどバッチサイズは普段あまり使ってないから断定はできん

diffusion beeとAutomatic1111の出力結果が違いすぎて話にならんのやが

誰かこれ分かる人おる??

そもそもマカーおらんか・・

モデル落とす時にsafetensorsってついてるのがある時あるけどあれってどう言う意味なんだ

>>178 そんなに借りれるか?

一昨日も1時間くらい待ってたで

paperはA4000借りてた人たちがGrowthに一斉に移行したんやと思ってたわ

ワイ自身も移行を検討してたし

ckpt Pythonで直接読めるようになっているデータの塊とスクリプトの欠片 スクリプトが入っていてそれをバカ正直に読み出し実行するので好き勝手やれた(AUTOMATIC1111では変な物が入ってないか確認される)

safetensors データしか入れられないようにした新形式

>>187 なるほどな

ワイproやからそっちのマシン見向きもしてなかったけど確かにgrowthのfreeはめっちゃ埋まってる気がする

evbm-lightなんとからって名称のモデルが検索しても出てこないんだけどこれってモデルの名前じゃないの?

昨日RTX4090今日買おうと思っていたモンやけど、マイニングで使ってたSuperflower1000Wで組むこと考えていたところCPU電源をなくしていた・・・

Yahooショッピングジョーシンで実質24万円で買えるところだったのに・・・

神様がRTX3070で十分って言ってくれてるんや・・・

NAI,Any3とkl-f8-anime2の中間くらいの発色になってくれるvae無いやろか

>>176 分かんない。とりま、学習にはキャラの背景透過画像 正則にはwiki参考に透明png入れてる

でもそもそも、キャラは背景透過しないといけないのかもよく分かんない

何も分からん すべて分からん

>>194 作戦失敗という経験もあるからね

>>195 ほなワイもええか・・・。とりま学習素材だけで勝負してみるやで。

でとりあえず学習初めて見たらこんなん出て積んどる。昨日は普通に学習できたんやが・・・。助けてクレメンス・・・。

「subprocess.CalledProcessError: Command '['E:\\stable-diffusion-webui\\LORA\\sd-scripts\\venv\\Scripts\\python.exe', 'lora_train_popup.py']' returned non-zero exit status 1.」

Lora使いたちは自分で学習させて用意してるんかな

中華TIみたいにどっかにまとめておいてある場所とかないんやろか

>>197 射撃能力:60

スタミナ:40

精神力:120

作戦成功率35%

総性交回数:2800

腟内総射精量:134853ml

妊娠回数:153回

出産匹数:78653匹

正則化画像って学習画像のクラスプロンプトで作るんとちゃうんけ?学習内容が10_hage 1boyだったら学習に使うモデルで1boyの画像を沢山作るみたいな

wikiやREADMEや過去ログ見てそう解釈してたけどあっとんかな🤔

尚さっきはじめた初学習では面倒くて透明pngを使った模様🤪

HNプロンプト内に書き込むようになったんか複数選択もできるんか

学習画像と正則化画像っていうのは

正則化画像を学習画像に転換することでその差分を覚えるって話やから

キャラの透過画像を学習画像

全面透過画像を正則化画像にすると

無からキャラを出現させる形式での学習になる訳や

正則化画像無し学習ってのもこれと似たようなことをしとる

理論的には邪道なんやけどクラストークンで自動生成したグチャグチャ画像を正則化画像にするよりは余程マシやから多用されとる

>>206 ほーん適当に生成した画像使うなら透明画像使った方がええんか

ほんならガチで作ろうとすると正則化画像も厳選しまくらんとあかんてことやんな

あたまおかしなるで😰

>>207 そこまで難しく考えなくてもいいんだけどね……LoRAは学習時間も短いし、かなり反映されるから

とりあえず正則化画像ナシで、学習画像にキャプションつけてやってみたら?

あと画像群にキャプションをつけたら、

フォルダに付けたインスタンストークンやクラストークンは無視されるだけだよ

>>208 キャプション付けて透明画像を正則化にしてとりあえず成功したやで!確かにすぐ終わるしこれから自分で色々試してくで

フォルダ名のは無視されるんは知らんかったサンガツ😁👍

痴漢しようとしたらおかしなことなって草

【腸内環境改善で免疫力UP!】

腸の健康を保つことが免疫力を高める鍵と言われていますが、そのためには腸内の善玉菌を増やすことが大事です。

☆発酵食品☆

乳酸菌やビフィズス菌を継続的に取り入れ、善玉菌を増やしましょう。

(納豆、ヨーグルト、チーズ、味噌、黒酢、麹、ぬか漬け、キムチ etc)

※ただし塩分の摂りすぎは免疫に悪影響なので注意

☆食物繊維☆

食物繊維は腸内細菌のエサとなり、善玉菌を増やします。

(野菜、果物、きのこ、海藻、芋類、豆類、未精製の穀物 etc)

最新版にアプデしたら動かなくなったから新しく1から入れ直したんだけど

前までできてたモデルの横でvae選択できてたの消えちゃった

全く記憶に無いんだけどこれなにでやってたんだっけか・・・

>>204 一般的なDB/LoRA の考え方はそれでいいと思うよ(kohya の解説もそれに沿ってる)

ただ4chan でやってるキャプションベースのやり方だと、正則化画像は使わないことが多そうだし

使う場合も

>>206 が言ってるみたいに、いろんな経験則があるんだろうね

>>214 ローカルの使い方の簡単に設定切り替えたいンゴ

sd_model_checkpoint,sd_vae,sd_hypernetwork,sd_hypernetwork_strength,CLIP_stop_at_last_layers,eta_noise_seed_delta

これのsd_vae?

すまん、Loraにトリガーってあるん?

ワイの環境ではトリガーとか指定しなくてもLoraを有効化するだけで自動的に生成画像に適用されてるように見える

前スレ見たらトリガーの有無は学習時の設定によるってレスもあったけどlora_train_popup.py使った時はそんな設定無かったんよな・・・

コマンドライン限定なんやろか

lora先人達の皆様方配ってくださってもよろしいのよ?

>>220 TIって書いてあるやろ

embeddingsフォルダにいれるんや

フルネルソンとか1girl, 1boy, sex, でアナル固めしてくれるからよくわからん

DLしたembeddingsとかの使い方が分かってねえんゴ

LoRAにしても情報が断片すぎてわけがわからないよ

>>224 使用するだけなら簡単

webuiを最新にして、花札みたいなアイコンをクリックすれば追加された項目が出る

そこで指定されたフォルダに各種ファイル入れるだけ

>>224 embの名前がプロンプトになるから使いやすいよ自分で変更してもいいし

>>222 あっそうやった🫢

あとは普通のプロンプトと同じようにbad_prompt_version2ってネガに入れればええわけやね

サンガツや

アップデートにwikiの更新速度が追いつかない

毎日ここに来るしかない

韓国の掲示板でとらいしのckptってふたつダウンロードしたんやがマージモデルって混ぜるモデルなんか?普通に使おうとしても駄目や

混ぜたいんやけどエラーが出て全く使い方がわからンゴ…

>>114 ワイもそれが欲しくて、アニメでそういうキャラをi2i してみたんやが駄目やった

どうやっても目を描こうとするし、そのあおりで顔が歪む

結局そこだけinpaintするしかなかった…

ワイも探してみるけど、見つけたら教えてや

血反吐吐きながらLora導入したわ…

でも誰だよこいつ

>>192 自分で作ればいいんちゃうかと思って、とりあえずVAEの比率マージができるextensionsは書いたが需要あるんかな

>>231 精度良いやん、少なくとも初期のうさだtiより断然良い

>>231 ええやん

TIのwikiと比較してこい

まーたi2i窃盗したツイカス見つかったんか

しかもワイの50倍もフォロワーおるやんけ

じわじわ生成見てるとHires. fix入れて75%辺りが最も理想な生成してんだけど

ここで止めて綺麗に出力させる方法ないんかなー・・・

ステップ数やスケール数弄っても上手くいかないわ

言われてみればアレよりは大分マシかもしれん…

>>236 一応自前

学習に6枚くらいしか使ってないからか分からんが、このポーズ以外させると崩壊する

今までのと新しいloraとembファイルとプレビュー適応させるの面倒臭い…でもやらないと楽出来ない…

両足を縛って綺麗に逆さで宙吊り(足が上で頭が下)を出す方法無いかな?

プロンプト結構弄ってるつもりだが、全然出てくれない

完成そす~

>>231 V興味ないワイには何がおかしいのか分からん

こういうの好き

>>240 そもそも逆さまが難易度高い気がする

AI君の苦手シチュというか…

これ知ってた?ワイは知らんかった…

loraの学習ってvarmいくつからいけるんや?6じゃ無理か?

>>245 自分で生成してプレビューできるのか

そっちの方が早いのかな

逆さどころか横でも肉塊になるしな

しかもBDSM系は意図的に学習してないんやないか

>>241 腕4本自然にできててええな

すごい出来や

>>240 腹ボテLoRAと一緒にmegaに落ちてる

4ch製の奴

>>244 そもそも学習元のデータ少なそうだもんね……

上手いことi2iで誤魔化すか……

>>225 >>226 あぁん情報が点で入ってくりゅぅゥゥゥ?

断片on断片でわけがわからないのォォォ?

って感じやわ

DLしたptをembeddingsに入れてそのptの名前をそのままプロンプトに入れれば密かに効いてくれる(そのptに入っとる構図を優先して選んでくれたりする)んか?

>>251 マジで!?

腹ボテ取ったときについでに拘束系のは取ったと思うんだが、それは違ったしな……

もう一回腹ボテのところ確認してみるよ

アカン、また「ページングファイルが小さすぎる」と出て学習できひん。ちゃんと設定しとるし、たった今こそそれで動いてたやんけ!

なんでこんな不安定なんやろ。画像は仮想メモリの設定やが、これでアカンとかある?LORAはEドライブにある。

>>224 > LoRAにしても情報が断片すぎてわけがわからないよ

そう思って自分のブログにまとめてみたーーSD-WebUI もLoRAに対応したことだし

さっきtwitterに書いたから、”webui lora”で検索すれば、最新のところに出てくるはず

いろいろ間違ってるかもしれないけどね(4chan のLoRAは多彩すぎて、いまだによく分かってない……)

>>245 自分で手動で同じファイル名にして画像おいてたわ

>>254 逆さ吊りか

勘違いしたわ

申し訳ねえから作ってくるわ

>>253 TIはそれでいい

LORAはワイのやり方だと最新にアップデートすると/models/Lora/に置いてwebui上で選択すればプロンプトに追記してくれる

多分公式実装前のやり方が色々ある

>>245 それ便利やな

しかしワイの所では

ValueError: File cannot be fetched: /home/<UserName>/stable-diffusion-webui/models/Lora/LoRA-test.png.

All files must contained within the Gradio python app working directory, or be a temp file created by the Gradio python app.

のエラーが出てプレビューが使えん

TI、HN、LoRA全部アウトやわ

dskjalニキ有能やなもろもろ簡潔でわかりやすいわ

でも日本語と英語を混在させるのやめてほしいわ

混在させるならInitialization text(初期テキスト)って書いてほしいわ

みんなこちらの知識レベルを想定せず"お前このぐらい知っとるやろ?"って前提で書いてるのもあって

翻訳しただけの言葉といえどいきなり出されると他のもんを指してるのかと疑ったりしてマジで初見の理解を妨げてくるんよな

まあ本人がこんなとこ見てるわけないけど

みんな自覚してないけどすげーナチュラルにルー大柴化してるよな

>>258 探してきたついでにおしっこ落としてきた

戴けるなら喜んで頂戴するけど、あんまり気にせんでええでぇー

こっちもこれを機会に挑戦してみるか

loraって、作成しようとする場合はどっちかというと汎用性より「特定角度のポーズ(特の定顔)」ぐらいの認識の方が良さそうなのかな?

たいていのエラーは

アナコンダがない、グラディオのバージョンが違う

そのどっちかやないか

>>261 git pullとかしてみるといいかもしれんな(無責任)

>>255 ワイもこれ出たけどPC再起動してPowerShell以外起動させずに学習開始したら解決したで

>>245 loraと一緒に公開されてるサンプルをi2iにほぼ無変換にして通して、設定し(ようとしたところで面倒でやめ)てる

>>265 このエラーはインストールフォルダ外のpngの参照をGradioが許可してないっぽい感じなんや

--lora-dirとかでstable-diffusion-webuiフォルダ外を指定してたらWindowsでも引っかかるはずや

ワイの場合はシンボリックリンクしてて実態は/mnt/d/Modelsにあるから、Gradioが怒ってる

ちな最新版で絶賛人柱中やでー

>>253 そうだよ、キャラクターとかだとそのまま出てきやすいから分かりやすい強調とかもできるから

webui最新版だと入れたファイルに画像プレビューをつけれて見やすいし選択したらプロンプトを追加してくれて楽になるよ

ただhnにバグがあるみたいだけど僕は把握しきれてない

loraちゃん学習時メモリ以外に食うよねメモリ16しか積んでないから

学習時はPowerShell落としとるわ

>>269 サンガツ

最新版git pullするか・・・

しょうがくせいでもわかるLoRAこうざをほっする!

>>274 赤ちゃんでもきついのにしょうがくせいはもう異次元やな‥

外人の作ったLora、README的なの読んでも結局適切なpromptやそもそもどういうコンセプトなのかわからない部の部員を募集しています

>>268 それ引っかかる人多そうだから改善されるやろね

ちな関係ないけどそのシンボリックリンクってやつでckpt関連だけ外付けSSDに移行しようとしてたけど(読み込み速度を早くしてほしい)、シンボリックリンクという名前が出てこんくてやり方分からなかったから助かったわ

>>268 少なくともextensionsの類はシンボリックリンク使ったらアカンね

動かなくなるやつだらけや

ワイはpaperspaceで最初は映像ストレージに入れてsymlinkしてたけど今は全部都度cloneしなおすようにしたわ

>>276 とりあえずloraそのまま読み込みや最新のでlora名プロンプトでも反映されるみたいなのでそこで試して考察していくしかないかもw

後はredomeとか説明文があったら日本語に翻訳してみるとか

>>275 かくちょうつくってるひとはもちろん、wikiかいてるひともかしこすぎるね!

このモデル、VAE、がくしゅうよう「でーたせっと」つかって、この「せってい」でやればどんなかんきょうでもさいげんできるよ!ってのがほしい!

いやこれぼくがやるべきなのか・・・

ルー大柴っていうか本家の実装が英語だと定訳ない単語を勝手に翻訳するのも誤解招きそうやし英語で書くほうがええやろってなったりするんや

LoRA講座の前にクソ簡潔でええから知識がほしいよな

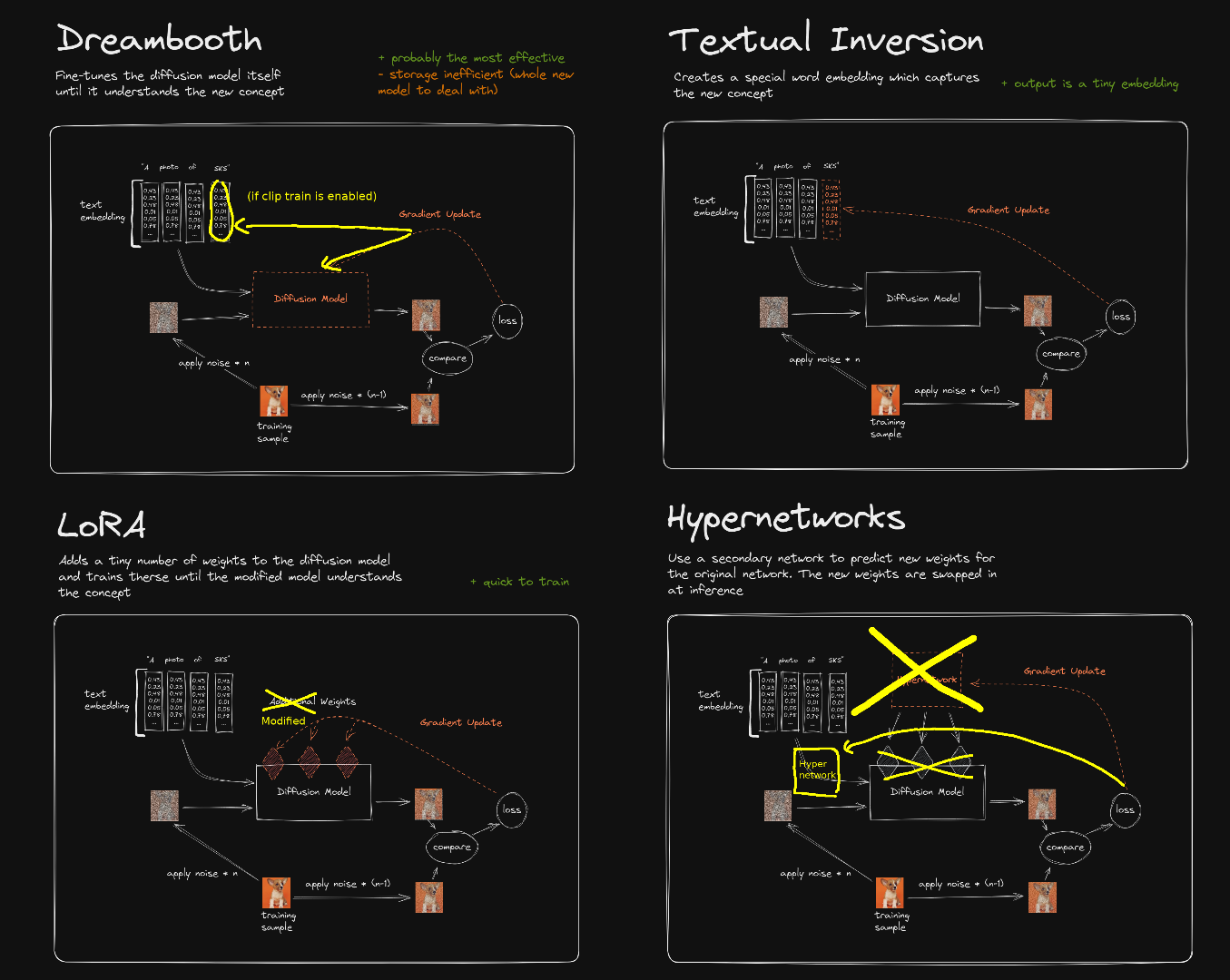

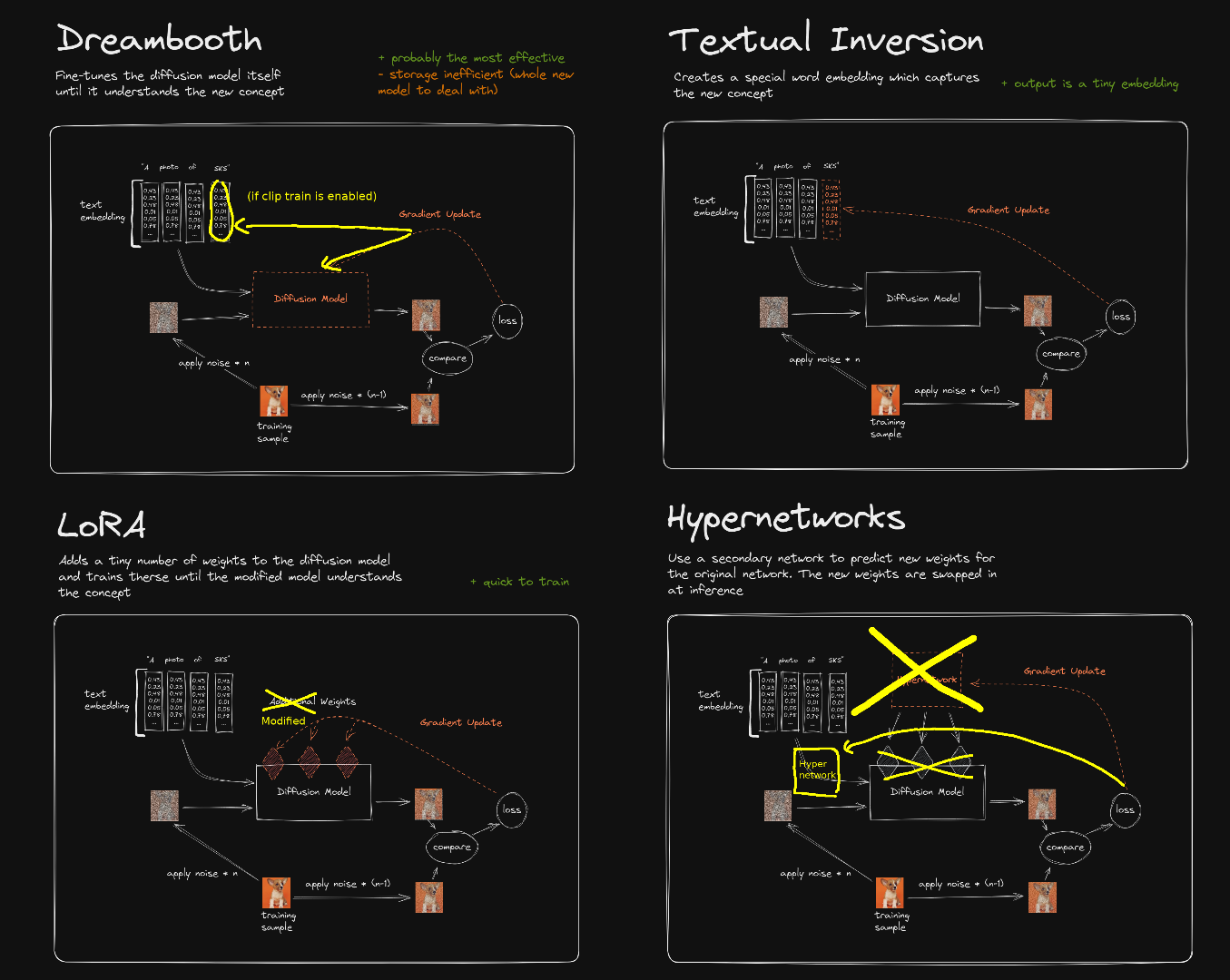

hn TI LoRA

何が違うのか

絵描きで言うとこのLoRAは脳内に記憶を追加して

hnとTIは脳の外側、絵描きが一時的に使う資料みたいなもんかと思ってるけど

よくわからん

なんでhnとTIが分かれてるのかもよくわからん

ハイパーネットワウクいうて大層な名前が付けられとるけど絵師が一時的に使う資料という意味では全く同じで

単にタグの付け方や使用法で区別しとるだけなんか?

それなら拡張子も変えてくれんとどっちがどっち用だったかわからんくなってまうやん

わけがわからないよ

ちんぽ

>>281 これな

何は無くともスケベデータセットをDLしてこのフォルダに入れてこのプロンプトで呼び出せるよってやり方を

アスカテストみたいな感じで説明してくれれば一気に雰囲気掴めるから

学習も同じ感じで一つチュートリアルがあればなァって思ったりするわね

注文ばっかでおちんぽやけど

>>285 んなもん新しい技術のほうがすごいってだけや

なんなら今覚えるならLoRAだけでいい

どうせすぐ次の新規格が出てくる

ふわ~っとでええねん

雰囲気で使っとけ

8GBのVRAMでHiresFix 1024*1536くらいできた人いる?

--xformers --medvramはやってるけど、やはり8GBだときついものがあるのかな

とんこつ、とんこつしょうゆ、とんこつしお

ぐらいの差だと思ってる ぽいんぽいん

ワイなんて1e-4みたいのが何を表してるのかわからなかったレベルやで

今では元気にpaperspaceで学習回してる

>>285 としあきwikiに違いが図入りで説明あったぞ

なかなか分かりやすかった(理解できない)

LORAがすごすぎてグラボ買い替えんとほんとついていかれんなって焦り覚えるわ

この図はわかった気分になれて勇気が貰えるからええよな

こういう理解で合ってる?

TI…厳密には追加学習ではない。的外れなものを出してくるのを「違う!やり直し!」とパワハラしてそれっぽくなるまで永遠やり直させる。出来上がるファイルはその虐待記録。ただのパワハラなので根本的にモデルに無い概念は何億回やりなおさせても完成しないが、既存の概念の範囲に収まるものなら割となんとかなる。

HN…TIと同じく的外れなものを出してきた時に「ここが見本と違うよね」と違いを説明してあげてやり直させる。出来上がるファイルはその説明の記録。ちゃんと学習してるので元モデルとTIでは絶対不可能な概念でも実現可能。

DB…根本的にモデルの学習を見本画像を元にやり直させる。出来上がるファイルは当然モデルそのものなので数GBになる。

Lora…DBと同じ手法で元モデルと新しく作り上げたモデルの差(厳密にはちょっと違う)だけを保存したもの。モデルそのものよりサイズは小さいし、元のモデルと似たモデルにならそいつにくっつけて使うことも出来るのでDBそのものを配るより使いやすい。

なんやかんや使えてるせいで1080の捨て所を見失ってる

ありがたい事なんだけど

>>292 このわかるようで何も分からん感じ

たまんねえぜ

>>288 fp16モデルで—no-half-vae付けなければ行けそうな気がする

そもそもStable Diffusionの仕組みが分かってないと、「俺をなんとなくわかった気にさせてくれ」ということにしかならんのよね

Stable Diffusionの構造はこれがめちゃくちゃ分かりやすかったで必見や

https://twitter.com/tomo_makes/status/1573917132768702464 これ見ながらldmの中のCrossAttentionのコード読んでようやくTransformerが何か理解できたわ

LoRAはここのLengthy Introductionだけ読んでふわっと理解しとる

https://github.com/cloneofsimo/lora https://twitter.com/5chan_nel (5ch newer account)

TI 対象画像を出せるプロンプトを機械的に見つけ出して、そのプロンプトは人間には理解できないのでptファイルでデータの塊として保存する

HN プロンプトと出力の関係性の傾向をいじる外部監督機構をモデルに後載せして学習する

DB 画像の対を元にモデルを再学習する

LORA モデルの一定の領域を切り出してDBと同じような仕組みでそこだけ再学習する

TIはモデルの中に欠片すら要素が無い物はどうやっても出せんし少ないなら精度がガタ落ちする

HNも中身いじれるだけ多少マシな程度で似たようなもの

DBは新たに覚えさせるので未知の物を覚えさせることができるがモデル全体をいじるので重い

LORAは一つの物覚えさせるだけでモデル全体いじる必要ないやろと生み出されたもの

HNが画風学習に良いとされているのは傾向いじるだけでモデルの中にある知識自体には一切手をつけんからやな

大体最初の主語(インストール先が ローカル環境のautomatic1111内で行けるのか、cドライブ直下じゃないとだめなのか)の指定が無くて躓く(現在進行形)

なんでも気にせずcドライブに突っ込むにしては、cドライブの空きが無さ過ぎる(残15GB)……

Cドライブ今SSDで250GBしかないし、1Tぐらいに買い換えるかな……

>>301 確かにno-half-vaeつけてたわ

あれって逆にRAM節約できると思ってたけど違うんけ?

当たり前やけどLoraの学習ってベースのモデル選択も重要なんやね

基本7thしか使わないからなんとなく7thをベースに学習させてたんやけど、

それで出来たLora使うとそのままだと何かめちゃくちゃザラザラした質感の絵になって、

ある程度綺麗な絵になるまで倍率下げると今度は再現度が無くなるという使いにくい代物にしかならんかった

それでキャプションとか学習率とか変えながら今日一日試行錯誤してたんやけど、

ふと同じ素材と設定でAnythingをベースに学習したら一発で綺麗に出力されて再現率も高いのが出来たわ

画風覚えさせるのは今もHNが優位って認識でええんよな?

何もわからんままGPUは回り続けている

>>305 half-vae (fp16) にはしないってオプションなので、最後に32bitになってメモリ食うはず

dbやthは大本のnaiがいいみたいなのかなり昔に何処かで見たけど今はどうなんだろう

>>309 そうやったんか、サンガツ、外して試してみるわ

>>310 色々混ざったloraとhnとtiだわw

理由はnaiベースっぽいモデルが多いから見たいな感じだったと思う

人のcolabを改造したやつ使ってるけどwebuiに機能追加する方法がいまいちわかってない

>>268 COMMANDLINE_ARGSに--administratorつけてもあかんか?

ちと教えてほしいんだが、たとえば性器が苦手なAnythingでも、loraで性器を学習させれば描けるようになる?

であれば学習に挑戦してみたい

>>307 画風と言っても大抵の場合、本当に求めてるのは眼鼻口の描き方だけって感じのそとが多いからそれくらいならTIの方が向いてる感じがする

独特過ぎる頭身や身体の癖や塗りやディテールがある画風ならTIじゃダメなんだけど、結局HNよりLoraになるんじゃないかとか

「サイズデカくて配布は難しいし、別モデルへの使い回しも効かない」というDBの最大の弱点がLoraで解消されてしまってHNは存在意義が危うくなってる感ある

>>317 それであってると思うんだけど分からないw

TIって結局モデルの中に入ってへん特徴はどうやっても精度出せんから微妙なんよな

マイナー性癖は今やLora一強や

HNの立ち位置については原点に立ち返って考えるといいんじゃないだろうか

HNはNAIの中の人の「全ての絵がケモっぽくなるパラダイスみたいな追加機能を作りてえ」という要求がスタート地点なんやろ?

だから特定の作者の顔の描き方とか特定のプレイとか特定のキャラとかそういう感じじゃなく、「出てくるすべての女の子をケモにしたい」とか「出てくる全ての女の子を球体関節にしたい」とかそういう使い方をするものなんじゃないかなって気がしてる

>>304 StableDiffusion専用の動作用SSDと記録用HDDを増設しよう

>>304 ワイは導入したあとしばらく使ってNVMeのSSD増設してstable-diffsionのフォルダごとこの増設SSDに移動して無事動いてるで

画像データの出力先はHDDや

ニキもSSDとHDD買おう

>>317 性器を描くだけならgape60をマージするのがオーソドックスかつ手軽やないか?

Anythingであれば定番のマージレシピがwikiにもあるで ただそれがすべてのモデルに通用するかというとわからんが

>>320 昔はTIが一番使い勝手良かったからね追加も簡単だし今は変わってきたかもw

Loraで続編出ないエロゲを学習させたんだけど再現度高ぇ...

これはなんか色々できそう

>>288 ワイも8GBやが1200*1600でやってるわ

ただ64の倍数の方がメモリ少なくて済むって前スレで見たのでもっと行けるのかもしれん

>>326 これ続編がありそうな話なのか(やってないけど見ただけでわかるw)

>>316 あかんかった

image browserの表示の関係でadministratorは付けてるんだがそれでもエラーになる

>>327 正確にはちゃんと検証した訳じゃなく、64の倍数で落ちてなかったのがそれより小さい非64でやったら落ちた、って経験則やから、本当に少なくて済むって意味とイコールなのかはワイにもわからへん

>基本的にTIファイルは学習時に使用されたモデルでの機能を想定しています。

>別モデルで動かした場合でもよい結果が得られる場合もありますが、基本的にはうまくいかないと思ってください**

闇雲に落としたTIファイル入れても塗りを変えられて微妙になるんはそういうことなんか

こういう情報が書いてあるとしあき有能やな尊敬するわ

敬礼や

>>229 そのモデルをもとに精度あげたモデルあげてくれたニキが前おったぞ

ハギングフェイスでdoll774ってアカウント探してみそ

生成しててちょいちょいエラー出ると いい加減 --no half vae 入れろやって注意されるんやが

ワイは意地でも入れんスタイル

TIはスイープトウショウ以外の全部消したな

最近のモデルとあんま合わないし

スイープトウショウだけやたら出来良いから今も使ってる

>>318 ありがてぇ

顔の描き方を似せたいもの

顔の描き方(デフォルメの仕方)を似せたいもの

顔の描き方と色の塗り方、色使いを似せたいもの

があるんやけど、上2つはHNよりもLoraが向いてるんかもなぁ

試せる範囲でいろいろ試してみるわ

>>330 すまんこのスレやったか

明日家帰ったら64倍数で実際どこまでいけるか試してみるわ

サンガツ

webuiのLoRAのtraining対応実装するんかな

AがBのちんちんしゃぶってる画像出したいのに二人仲良くCのちんちんなめ出すのやめて

>>340 使えるようになった以上、トレーニングの拡張とか来週くらいにはできてそうだよな

>>326 エロゲって素材集め難しそうやけど

どんな素材と設定にしたか良かったら教えてもらえんでしょうか

みんなが学習に明け暮れてる中ワイは普通に呪文生成や

箸休めに浮遊感どうぞ

>>327 ガチで?

差し支えなければ起動時のパラメーター教えてくれ

ワイのは

--xformers --medvram --no-half-vae --enable-insecure-extension-access --administrator --api --listen

上ので1024*1536のhiresfixがうまくいかんから、上の人に教えてもらった-no-half-vaeを外してみようと思っている

>>163 洒落てるね

>>231 なんちゃらぺこらってやつにしか見えないがあかんの?

7thは素晴らしいのだが学習ベースにするのは厳しい結果になることが多く結局NAI系になってしまう

>>281 4chanのLoRAまとめ訳しただけなんで分かりにくくてすまんこ

原文にはタグで段ボールからぶっこぬけるダウンローダーとか書いてあんで

https://seesaawiki.jp/nai_ch/d/kohya%5fsd%2dscripts%5fintro このページが大丈夫な画像使って例あげれるギリギリのような気がする

めちゃくちゃ初心者の質問で申し訳ないんだけど画像生成するときにモザイクになっちゃったり一色の画像が出るのってVRAM不足かな?

モデルによって差異があって原因が今一つ出てこなくて悩んでる

>>348 なにが違うんだろう?

Abyssorangeで学習しようかとか思ってたんだが、良い絵が出るものが良いベースではないってこと?

>>346 すまん今出先なので明日でもええか?

このサイズでずっとガチャしとるけどたまにメモリエラーで止まってる時はあるわ

>>350 モザイクをネガティブプロンプトに入れる

ワードはなにか忘れたわ

>>322,323,332

automatic1111 は2TBのM2SSD(sumsung)のgen4、

生成ファイルは4TB HDDへ出力にはしてるんだが

システムのCドライブが最低限のつもりでパンパンになってる

ということで、さっき普通のSSD(Crucialの)を1TDポチったぜ

M2挿せる場所1つしかないから、システム領域は寿命とか加味してM2は使わないで、一部大容量ゲームとautomatic1111用にしてる

>>352 めっちゃありがとう

当然いつでも大丈夫やで!

学習で使うモデルって基本的にNAIでVAEなしやない?

イラストでエロありってこれ以上好都合なモデルはNAIしか無いでほんま

>>354 補足

因みにインストール躓いてるのはloraの生成に必要な環境なんや……

wiki見てやってたけどなんか途中でエラー吐いてた

とりあえずCドライブにインストール試したりしてみようにも領域足らんくて半分詰んでたんやで……

git pullしてないのにいつの間にか画像生成時にブラウザ左下に127.0.0.1を待機してますて点滅するようになったんだが

目障りだな…

ワイも学習元はnaiにしてる

出力は7th,abyss,cinnamon使ってるけどちゃんとキャラでてくる

ほかのモデルでやるのは試したことないな

>>270 うおすげぇ VAEマージという言葉に惹かれたので拡張使わせてもろたで

\models\VAEじゃない場所にファイル置いてたからエラー吐かれたけどエラーメッセージを読める人間なのでなんとかなったわ

んでまあ結果なんだが,以下の比率でやったけど思い通りの結果にはならんかったな...

(A)Any3←だいぶB寄りの0.8でマージ→(B)kl-f8-anime2

>>360 vae無しみたいな淡い感じになってるな

どういう理屈でこうなるんやろ

skechだのinpaintsketchだのがバカ重いしすぐ画像が消えて機能しないのっておま環?

>>362 消えるけど機能はしてるとかだったりしない?

自分の環境だとそんな感じ

wuiにプログレスバー出ないけどコンソールはちゃんと動いてるから待ってると出てくる

って現象がinpaintだけで起こる

>>343 そこまで特別なことはしてないよ

エロゲのCG鑑賞から、学習したいキャラの周辺をトリミング

そこから、(anime-segmentation)というものを使って人物以外を透過させて学習用の画像を用意した。(30枚くらい作った)

>>363 4枚目に草ですわ

このままだと顔面に当たってしまいますわ

>>359 おー、マジか

前に見たやがてきみになるのキャラくらいのがloraで出せるなら、

もうモデル毎にキャラのDreamBoothする必要なさそうだな

前スレにLinuxニキいっぱいおったけど、みんなディストリビューション何使ってるんや?

ワイがLinux使ってた頃はMint全盛期やったけど、今は勢力図変わったんやろか

>>302 d8ahazard もkohya も、LoRAのコードはcloneofsimo のを参考にしてるしね

ただDBは、d8ahazard はShivamShrirao のコードだけど、kohya のは独自なんだよね、たしか

preview並べて見て思ったんだがloraってトリガー分からないのが辛くない?

使う時も息苦しさを感じる

>>360 確かに単純にはいかんので封印していたところがあるんで、配分は細かく弄ってみないとわからん

imgurに貼ったこれはうまくいったパターンやな

いずれVAEの学習スクリプトでも作ろうかとは思っとる

>>368 Ubuntuかなあ……機械学習系は強いしね

業務系もCentOSが8 でRHとの立ち位置が変わってから、けっこう移行してるみたいだけど

>>370 ちょっと面倒だけど、プレビュー画像にトリガー文字列もはめ込んでる

結局手打ち面倒だけど、無いよりは便利かなと

なんやかんやdebian/ubuntuがCUDAの新しいバージョンのサポート圧倒的に速いので相変わらずこいつらが主流な印象やな

Mintは一時期CUDAがdebian/ubuntu用のじゃ入らない時期があって、機械学習用途だと少し避けられてるイメージ

>>371 ほほぉ

挙動がまだ不安定とはいえ、十分有用に思える

>>270 は自己責任で使わせて貰おう、サンガツ!

>>368 sd以外ではarch派だけどsdはubuntuから作ったdockerイメージでしかやったことない

汎用性が高くて使えるプロンプト教えて

leech slug worm earthworm

はよく使う

Dockerのおかげでディストリあんまり意識せんでええんよな

>>379 それら in vagina もよくやる

>>353 --precision full --no-halfをつけたらひとまず形にはなりました

このオプションRadeonだとメモリ食いすぎてよろしくないみたいな噂を聞いたのでいい解決策がほしい

>>364 inpaintは問題ないんやけどskechとかいう機能が使えんのよな

画像放り込むとガックガク

まぁクリスタ使えばええか

俺はsingularity image作ってやってるけど、スタートはnvidia/cuda:11.3.0-cudnn8-devel-ubuntu20.04やね

>>288 もう解決したかもしれんけど、

>>36 は3070-VRAM8GBでhires使って出してる

4KモニタつなぐとVRAM足りないって言われるけど、バッチサイズ1ならもう少し上もだせるぉ

set COMMANDLINE_ARGS=--xformers --medvram --opt-split-attention --no-half-vae

set PYTORCH_CUDA_ALLOC_CONF=garbage_collection_threshold:0.6, max_split_size_mb:128

https://majinai.art/i/rNai8L-.webp GPUクラウドでもubuntu優勢ですしWSLもubuntuですし、やっぱりubuntuが多いと思いますわ

basil+zipangいいね

ちょうどいい感じの日本人顔

適用するだけで効果を発揮するHypernetworkとファイル名をプロンプトに打ち込むだけで使えるTIに比べてLoraは配布には向いてないよな

自分で学習する分にはタグ付けのtxt残しとけば良いだけなんやけど

>>383 モザイクって性器に使うやつやなくてモザイクアートの方のモザイクやったんか

わからんわそんなの

なんかワロタ

同じくモザイクって卑猥な方とおもってたわ

>>387 ウブンツならエレクトリックなクラゲさんだそうやそこは

>>390 なんか話が通じてないっぽいなと思いつつ解決策はわからんのでそのまま眺めてたw

>>375 いい作戦だがワイは打ち間違える自信があるわ

>>365 30枚も集められたんか…ちょっとワイにはまだ道のり通そうや

有難うございます

>>370 loraフォルダの下にサブフォルダ作って管理してるで

どうせ学習に使ったものは全部残しときたいから画像、txt、エポックの差分まとめて入れとる

HNとloraとTI組み合わせたら最高だな…組み合わせ自由ってすげぇわ

TIは「言語化できないけどこういうのできない?」って聞いて、AIが「分かる」って場合はよく効くけど「分からん」って場合は効かない

LoRAの場合は「知ってるけど言われないと分からない」状態

なのでLoRAとTIは相性良いのではと思ってる

ハイレゾのアップスケーラーって何が変わってるんだこれ

組み合わせるとわりと喧嘩するんよな

バッチリハマると楽しいんやが

①アップスケーラーには2種類ある

Latentか、Latent以外かだ

②Latent以外には何個も種類がある

Noneか、なんとかGANとかLanczosとかとにかく色々だ

③本当はLatentにも6種類くらいある

gape混ざってるモデルで興味半分にグロ画像生成したら予想以上のが出てきてダメージうけた……マリモちゃんショック思い出したわ

こんだけ学習の選択肢あったら他の下位互換のやる必要無いものも出てくるだろうな

HNお前クビか?

>>405 君の心を鍛えるためにまりもちゃんぱっくんLoRAを作らねば(使命感

>>351 これは予想やけど、ベースモデルが何ベースのタグ付けしとるかに依存するんやと思う

Instaみたいな非DanbooruマージでDanbooruタグの血が薄まると

TaggerみたいなDanbooruベース自動タグ付けでの学習を邪魔するんやないか

うまく行ってるモデルは基本Danbooruの血が濃い気がしとるし🤔

>>372,376,378,385,387

Linuxニキやっぱ沢山おるんやね🤗情報サンガツ!

普段使いとかやなくて環境に依存するもん使う場合はカスタムディストリ避けたほうが良さそうなんやね

Linuxに移行したらUbuntuかDebianにすることにするで!

>>326 メーカーの代表がお亡くなりになっちゃったから...

ワイもエロゲキャラ学習させてるけど立ち絵の5枚(左右反転でx2)の十枚くらいで十分再現出来てビビったわ

>>409 LinuxはDockerあるからもうあんまり関係ないで

>>392

正直ubuntuちゃんにはあまりマスコットのイメージがなくてよ

あとうまくビリビリにできませんでしたわ無念

最後の講義で完成できないことがエネルギーっ言葉が出たけどAIやってるとほんと染みるな

>>411 Dockerでパフォーマンス変わらんなら良さそうやね

頭に入れとくでサンガツ!

別にMint気に入ってたわけやないからUbuntuでDockerとかになるやもやけど

整理しんどいけどプレビューでlora並んでるの見ると気持ちいい

>>414 髪の毛別のオブジェクトと繋がりがち問題がいい意味でアクセント効いててすこだ

M.2SSD 1TB*2買って不満なるとは思わなかったな

換装高いしめんどいの辛いわ

【従来の方法】

None…ほんとになんもしないで単純拡大してギザギザになるのとかは放置

nearest…単純拡大だとギザギザになるので1番近所の画素を参照していい感じに補完する

bilinear…周囲の2x2ピクセル(4画素)を参照していい感じに補完する

bicubic…周囲の4x4ピクセル(16画素)を参照していい感じに補完する

lanczos…三角関数とか使っていい感じに補完する

【学習系】

ESRGAN…学習データとか使って「学習に使った他の絵の傾向からして多分ここはこうなってるよね」といい感じに捏造する

【Latent】

他は拡大してからノイズを混ぜて描き直していくけどこいつは先にノイズを混ぜてから拡大してそいつを描き直していく(と俺は思ってたんだけどdskjal氏ば逆で説明してるからそっちが正しいのか?)

あくまでワイの把握なので本当に正しいかはわからん

>>306 any3ベースにしたら捗ってる。ありがと

で、sitaベースで画像にしたり。

上下モデルの人ありがとう

どっかで学習に使うモデルがfp16だと必要VRAM少なくて済むとか言う話見たけど本当かな

LoRaは万能だったDBのデメリット部分を補って今ある中ではとりあえず選んどけばもっとも限りなく正解に近いみたいな感じか

ダウンロードできるLoraってどこかにまとめてあったりします?

LORA(やHN)の学習で、1e-4でやってみたけど適用したらstrength0.8ぐらいがちょうどよかったなんて場合、

学習率をちょっと下げてやり直したほうが結果良くなったりする?

>>428 場合による。

むしろ良くない局所解に陥っているかもしれないので

学習率を上げて再開するのも選択肢の1つ

よっぽど壊し切る前ならもち直せるし、

学習率を下げると時間がかかるだけなので

多少過学習になってしまってでもできるだけ学習率は上げるほうが生産性が高い

>>417 > Dockerでパフォーマンス変わらんなら

う〜ん……パフォーマンスってことなら、VMほどじゃないにせよすこしは影響するけど

それでもDockerなら、環境をコンテナで分けられて、pythonとかtorch とかバージョンで悩まなくてよくなるんだよね

webui もsd-scriptsもdiffusers もほかの機械学習系アプリも、バグ以外は設置で困ったことがないし

いい感じの絵柄と構図引けたから再現しようと同じ設定で生成しても同じものができない…

>>431 NSFWをクオリティタグだと思って打ってそう

>>237 それ多文化長いプロンプトで75トークン毎にきりかわったところ

75トークン内に収めるか事前にANDで切っておくとANDセクションごとにi2iしている状態になるので制御しやすい

>>292 DB

拡散モデル本体を更新

TI

テキストエンコーダに概念追加(拡散モデルは更新してないから新規概念獲得には向かない)

HN

既存の拡散モデルの重みの一部を新しい重みにすり替える

LoRA

既存の拡散モデルの重みの一部に新しい重みを加算する(マージしてる感じ?)

導入以来一か月近くwebui更新なしで使ってたのによりによって今初アプデしてしまった

しかもSSDやなくてHDDで使ってたせいか

更新時お前入れた時の奴と違うみたいやからアプデさせへんでって言われてびびった

最新の1111webui環境のニキおったら聞きたいんやけど、webui標準になったlora読み込みはエクステンション版のloraとかしか読み込めへん?

もうちょい具体的に言うとkohya版lora読み込めるんかが知りたい

最近のアニメは作画良いからキャプチャを学習素材にしてもちゃんとしたものができあがるな

>>438 何かファイルに変更加えてたからgit pullで「修正されたファイルの変更を取り込んでないぞオォン?」って言われたんじゃないん?

>>442 音楽付けたらドキュメンタリー始まりそうやな

lora結局どのくらい学習させればいいのか分からんけど

使う時に0.7,8くらいにしてキャラの特徴のプロンプトを盛ればいい感じに出るからヨシ

>>443 wikiの受け売りやけど2台?のPCで共有してたりすると出る事があるみたい

自分の場合PCは1台やけど単に容量の関係でSSDよりHDDの方が良さそうやからそっちに入れてほったらかして今日初めてやったらユーザーが違うって出たんや

wikiなかったら詰んでたわ感謝

分からないloraやembを精製してみてプレビューする作業に入ったけど何のloraか分からないのが多々あるw

loraに挑んだら難し過ぎて挫折した

導入から動かすまで全てが難し過ぎんだろ・・・

グラボ買い換えたから俺はHNで我慢するもん!

似たような人は多そうだわ

今日気づいたら2千枚生成してたわ

ハイレゾ打率低すぎやでほんま

ちょっと考え直すわ

automatic1111のi2i inpaintで剥ぎコラ作りたいんやが

fillモードにしても黒い服とか着てるとマージされて勝手に影落とすの、どうすりゃええんや

denoising strengthを上げると色が明るくなっていくのでおそらく元画像の色がマスク部分であっても参照されてるっぽいんやけど

マスク部分の色を一切参照しないようにできないんか?

>>437 DB

特徴から画像の再現のしかたを学ぶ

TI

特徴を割り出す

(新規概念は表現できないが、汎用モデルだとそもそも知らない概念なんて殆ど無い)

HN

特徴から画像を再現する中間に割り込んで、

特徴をよりモデルにとって望みの画像を出せる形に加工する

LoRA

DBのパッチ

ヴァアアアアア

git pullしたらUIめっちゃ変わっとるやんけ

ハイレゾはなぜか乳首増やすのやめちくり

NAIちゃんは人体の構造を理解しろ

>>451 肌色に塗った絵作ってからi2iすればいいんや

プレビュー作っていくの楽しいわ、でもloraは専用の呼び出しプロンプトもあるんだっけ?それが分からないとちゃんとしたのは出にくいのかなw

>>454 ハイレゾで乳首増えたりする奇形化避けたいならアップスケーラーでLatentは使わずにデノイズも0.5ぐらいでやるんだぞ

Noneで0.5だと線がイマイチくっきりしなくて微妙なこともあるけど

>>457 書き込み増やしたくてlatentにしとるのに他の使ったら本末転倒や…

もちろんdenoising strengthは0.5くらいにしてある

>>454 ハイレゾでスケール上げた瞬間にイラストが破たんするパターンあるよね

あと高解像度の1発出しでも2人目を描き込み始めたりする

多分、学習元のサイズが影響してんだろうな・・・

>>455 サンガツ!

肌色に塗って保存してから、もっかいinpaintで読み込んで肌色に塗った部分をマスクって感じか?

高解像度で破たんするのはauto-sd-paint-extを入れてkritaでinpaintするしかない

あと乳首とかヘソみたいな微調整なら他所からコラ移植とか手描きの方が早いと思う

プロンプトもloraとかみたいに羅列させれたら楽なんやけどな

リスト見てプレビューをワンボタンでプロとネガ入れてくれたりとか

>>458 じゃあもう乳自体が奇形にならん限りi2iやね

Latentは周囲の色に合わせた補完や拡大じゃなくてノイズ拾って再描写してるから小さい画像で出ずに済んだ部分をわざわざ引っ張り出してくる作業に近い

>>461 NAIのは笑顔がええよな

背景がショボいから自然と顔に目が言って笑顔が引き立つんやと思うわ

でも真ん中の3枚もええ表情しててハッピーやわ

https://mega.nz/file/0LYjTJIQ#fERkV2zDS8XNxVExYUHkBPe716mKquRlZn3TGpYYTFA https://majinai.art/i/-fHTAAI ワイもふいんきでやっとるから参考にならんかもしれんがこれからLoRAやる人用にお試し素材おいとくわ

MMDで雑に撮ったやつだから品質は悪いけどそれでもそれなりになるのがLoRAのいいとこや

4ch方式で作ったから正則化画像なし

キャプションはwd14-taggerで作った後キャラの特徴を抜く(BooruDatasetTagManagerが便利)

学習素材16枚、繰り返し回数10、1e-4で5epoch、3090で8分ちょいで完了

このスピードなら寝てる間にとかしなくていいから手軽や

東方、原神、Vtuverとか最初からモデルに学習されてるやつ(wikiのキャラ再現にいるようなやつ)は相乗効果で結果がでやすいから初めての人はその辺からやるとモチベ上がるで

むしろ普通の巫女服の学習が必要なぐらい東方要素が最初からモデルに染み込んでいる

脇出しすぎや

>>467 キャラの特徴タグを抜くって言うのは髪色とか髪の長さとか目の色とかそう言うやつ?

LoRA導入するに当たってあれもこれもモジュール無いよって言われてpip installしまくったんやけどこれでええんよな...?

>>467 知らんキャラやけどかわええな

非常に参考になるで

>>460 これを

こうして

肌色部分をmaskしてinpaint

プロンプトはそれっぽいのをでっちあげる。

denoise strengthはグッと上げる。

あたりですかね

loraのプロンプトのみとネガだけならちゃんと出てくるわ風景っぽいよく分からないのもあるけどキャラはこれで見つけるのが良さそう

>>471 プロンプトが重要なのにそこを省いちゃいかんでしょ

>>471は元のプロンプトで服装部分をnudity, open clothes, breast に変えただけの適当処理やからなぁ……

>>474 あ、breastは入ってなかった。最初の2つだけだ

nai始めて1カ月

ローカル始めて2日のワイは、まだlolaとか手を出さん方が良いのかなあ。

abyssとか7thの張り付いた服に浮かび上がるへそとかに感動してるレベルまだ。

>>477 明日やるなら今日やって悪いことは何もないんやで

> --training_comment オプションを追加しました。任意の文字列を指定でき、Web UI拡張から参照できます。

sd-scriptsの更新で色々変わったみたいやけどこれで呼び出しキーワード入れてくれるようになるとはかどるな

>>471 やってみるわ

クソわかりやすい説明サンクス!

>>469 としあきDiffusion読んで試したけどキャラの特徴抜いてトリガーワードを先頭に入れるみたいな方式やな

ワイも正直よくわからんのやけど

以前はキャラの特徴をキャプションに入れたんやけどそれもそれなりにうまくいってた

https://imgur.com/a/FagqpJU https://imgur.com/a/p1LuTTd ただ前者のやり方はBooruDatasetTagManager使うとすぐ終わるからめちゃ楽なんや

結果が変わらんならそっちでええかなって思っとる

マジで無知なんだが、キャラクター無しの背景画像を綺麗に描画してくれるモデル/loraってあるんやろうか?PCの壁紙作りたいんや

>>477 手始めに先人が作ったのを適応して遊んでみるのもありやで

>>482 naiで出してる人達はいたよプロンプト忘れたけど背景のみならsdやミッドジャーニーでも得意だった思う

モデルもあったと思うからcivitAI覗いてみたらええと思う

>>477 呪文研究に飽きるまでは、適当に回して遊んでる方が良い気がする

やってる内に「俺の欲しい〇〇が出ねえ!」ってなるから、そうなってからその時の最新技術学ぶ方が無駄が無いと思うよ

>>482 そういうのあるかは知らんけど背景詳細をみっちりプロンプトに書いけば普通に背景だけにならんか?

それでも人出るならネガに入れればええんちゃう

>>471 ちなみにwebUI最新版のinpaint sketchのmasked content をoriginalにしたら同じことがブラウザ上でできた!

一応共有しとくわ

背景ばっかり出るプロンプトに1girl入れて遊んでたから背景のみは出せると思う好みのが出せるかは知らないけど

>>482 それこそ古の汎用モデルに画家名ぶち込むプロンプトで。

昔に作ったやつだから小さいな

これはtrinart2っすね

レスくれた兄貴達サンガツ

悩みとしては玉無しふたなりがでないのとか

インペイントで女体に竿生やすと勝手に金玉書かれてまんまんが消えるのとかですかねぇ。

今はアビスの美しい陸上女子の腹筋で発電ばっかりしてます。

いろいろためしてみるわ

>>487 実はそっちでやってみようとしたんだけど、うちだとエラーが出て諦めたのね……

>>484 サンガツやで。確かにミッドジャーニーは背景系強そうやね。ただローカルでガンガン回したい気持ちがあるから、とりあえずcivilai見てみるわ

>>486 人物に対してチューニングされたモデルはその分背景のクオリティが下がってしまうのでは?みたいな思考があったんやけど、手元で実験はできるんやから試せばいいだけやね…。ありがとうやで

>>490 うおおおおめちゃくちゃ綺麗や…

trinartも調べてみるで!サンガツ

>>490 naiのディスコで今拾った背景プロンプトを突っ込んだらこんなのが出たからプロンプト次第で大体のモデルでも出る思う

この大きさで結構時間かかったw

AbyssOrangeMix2_hard

basil mix

>>492 ワイもやsketch動かん

ペイントツール使ってるけどちょっとしたものはwebuiで済ませたいわね

>>416 1枚目の日焼け跡いいね

学習かガチャ?

sketchはSend toで送ると激重になるからアップロードして使えってどこまで見たで知らんけど

夜景と煙草と女

パスかかってなかった

5chのURLジャンプページのせいで

>>501 パスなんてかかってないがお前は何が見えてるんだ……

sd-scriptめっちゃ更新されとるやんけ

クラウドやとコミット固定しておかんと罠にかかってしまうな

>>501 たぶん不具合があってアドレスがおかしいんやと思うけどmegaの複合キーは大体#とか最後の/の後ろとかを入れるとええで上のはfERkV2zDS8XNxVExYUHkBPe716mKquRlZn3TGpYYTFAだと思う

昨日アプデしてから起動おかしくなってスレ参考に

--gradio-queue 追加

"sd_hypernetwork": "null", 変更

してなんとか生成にたどり着いたものの全体的にモヤがかかってる気がする…

ハイパーネットタブも消えたまま…

今回のアプデ後もみんな普通に使えてるの?…

そういう時は普通にリネームで退避させてから入れ直せば早くない?

最初の頃はxformers入れるのにも細々とした操作が必要で一時間くらい掛けた記憶があるけど今はbatクリックするだけじゃん

>>508 赤ちゃんで入れたものだけど今の所大丈夫だよ精製は遅くなった気がするけど気のせいかもしれない

コマンドは--no-half-vae --no-half --precision fullのみ

直でDLしてきて中身上書きしてみたりローカルなら新しいwebuiと1個のモデルで試してみるとかモヤがかかってるのはvaeが効いてないのかも

>>509-510 モヤかかってる問題はVAEが表示されてるのに何故か効いてなかったぽい

VAEを変更しまくってたら機能が復活したっぽい

でもハイパーネットタブはダメっぽい…

"quicksettings"にsd_hypernetwork,sd_hypernetwork_strength追加しても出て来ない…

ハイパーネットタブ死んでもうた…さよなら…今までありがとう…

だからグダグダやってるこの40分の間にgit cloneし直してwebui.user.batクリックしてたら解決する話やろがい

>>513 モヤ云々はわからんがハイパーネットタブが無いよって状態は正常。

ハイパーネットタブは廃止されて花札マークからハイパーネットを呼び出すようになった

HNのボタンを押すとプロンプト欄に追加される。デフォでは強度が1になってるから強度変えるときはそこの数字を変える。

"sd_hypernetwork"をnullにしろってのは古い設定を消すため。正確には"null"じゃなくnullにするべきやろな。"null"でもエラーとして無視されるだけだとは思うけど。

あと「なんかようわからんから設定リセットしたい」って場合ま

生成自体は出来てるならcloneしなおしまではせんでもせいぜいconfig.jsonとui-config.jsonを消すか退避するくらいでええと思うで

それでもダメならvenvを消すか退避して

それでもダメなら再clone(venv消してもダメなら再cloneでもダメなこと多そうだけど)

おっぱいまんこに疲れたときは風景画や適当にAIの独創性に任せて癒されるんや

>>515 はう!!!!!!!!!

新機能に移行されてただけなのね!

作り直してもタブ出てこんわけね!

悩みが解消されたら作る気分なくなって眠くなった…

おやすみありがとう…

誰か知らんけど新しいモデル出してるやんと思ってツイッター飛んでも

AI絵の事まったく呟いてない外人ニキだったりするからびびるわ

>>519 このスレにいれば学習してないただのMixモデルで困ることはほとんどないと思うけど…

個人的にorange mix系列と7thAnimev3で自分が求めていた物は完成された感ある

後はもう指が綺麗になったとか文字が出るようになったくらいの技術革新的なモデルが出ないと乗り換えられないわ

>>442 このモデル検索しても出んのやが

なんか間違ってる?

>>523 El Zipang_test1.4

test_no_zipang.safetensors + El Zipang_test1.3.safetensors -> Simple Merge!!!

まだ上げてないか簡単なマージだから自分でやれって事ちゃうんかな

test_noは上がってたで

はあちゃま参考にして、🐰できたから投下しとく

学習25枚、512にリサイズしてkatanuki使用。tag編集あり。

正則に透過画像使用

LR1e-4、network dimは64。全185ステップ5epoch

学習自体は5分くらい

any4.5は経緯もあって舐められがちだけどモデル自体はかなりええよな

1111更新したら起動時に

Exception in ASGI application

ってエラー吐く用になったんやけどなんやこれ…

公式調べても更新してテキスト情報をpngに保存するにチェックいれればええんやでって書いててチェック入れたけどまだ出るんやが…

同じような人おるか? おま環?

>>529 設定ファイル消すかvenv消すか再インストせい

>>530 再インストール安定か…

まぁ変に困るような設定いじってないしそっちのええか…

拾ってきただけのloraだとトリガー分からんことあるな。特になんの説明もなかったりするし…効いてるのかどうか分からん。loraって設定を適用させるだけじゃ効果ないよなやっぱ。プロンプトでトリガー打たんと意味ない?

自分で使う分にはトリガー別に設定しないからなあ

設定した方がいいのは分かるけど

配布しないし

seed固定させて強弱か用途の近いプロンプト入れれば判断つかないか

学習方法によるんやないかな?

tag付き正則画像無しで学習して全体に反映させてるやつはなんかプロンプト引っかかれば出るやろ

キーワードに紐づけて学習させてるのはキーワード入れないと過学習でもない限り出ないんやないか

影響を受けてない単語に覚え込ませたら衣装替えがしやすいとかそういうのあるんだろうか

フルネルソンのloraみたいに複数の体位とかキャラが設定されてるloraにはタグ付け必須なんじゃないの

kohya氏のLora使うための拡張入れたけどUIにタブが増えなくて困ってる

webUIは1月の頭に更新したのが最後

最近は動かなくなったとか聞いて更新できてなかったんだけどバージョンのせいでうまく拡張機能が動いてないとかある?

Loraって二人以上のキャラ学習して同時に呼び出しとか出来るんかな

出来ないなら心を鬼にしてレズキャラにチンポぶっ刺してる絵で抜くが

>>346 遅れてすまんな

set COMMANDLINE_ARGS=--xformers --opt-channelslast --medvram --gradio-img2img-tool color-sketch

set PYTORCH_CUDA_ALLOC_CONF= garbage_collection_threshold:0.6 max_split_size_mb:128

3070やがこんな感じや

ワイの環境だとno halfは付けても付けなくてもあんまり変わらんかった気がするわ

2行目のやつはVRAM再利用 (60%消費で再利用)とデータ断片化防止(128MB以上)らしいがよくわからん

生成中のリアルタイム表示はもちろん切っとるで

>>544 最新のアップデートで公式に対応しとるぞ

>>544 その動かなくなったと騒がれたタイミングから入った機能だから、更新しないとダメよ

更新しても花札みたいなのでてないんやが設定にあるんか?

>>548 >>549 朝からサンクス

更新してみるお

DBでキャラ再現するとチンポどころか裸にするのも苦労するけどLoraはきちんとタグ付けすれば裸にしてチンコ入れられる感じか?

>>550 stylesとかのプロンプト読み出す場所や

小さいアイコンが5個並んでる真ん中にないか?

>>553 ただ単に覚えさせたものが貼り付いた感じで出てくるようになるパターンと

うまく追加プロンプトを受け入れるパターンがあるっぽい

うちの古いdreambooth extensionで動かしとる謎のLORA環境だとLearningRateを下げてじっくりやると後者になるわ

多分急速学習するとモデル既存の要素を使わずにLORAの中で画像再現するようになってダメになってるんやないかな

DBは作者大変そうだから窓から投げ捨てたわ

STとsd-scriptで対応してる

ん、最新版にアプデしてpng infoで取り込んで生成したらバッキバキのリアルな3D出してきてクソビビってたら

Checkpoint 7th_anime_v3_testA.ckpt[ハッシュ] not found: loading fallback 3DKX_1.0b.safetensors [ハッシュ]

いうてモデルデータ見つけられなくなってるっぽいわ

何直せばええんやこれ

>>545 ワイ使ったことないから知らんけどぼっち・ざ・ろっくで学習したやつかな

>>557 ハッシュの表示桁数?みたいなのが変わったから

旧バージョンで生成した画像のpnginfoじゃ飛べなくなった

手動で選べばOK

にわかなんやけどvaeファイルないモデルってどうしたらいいんや?

適当なvaeリネームして代用するしかないのか?

>>553 チンコでにくいモデルじゃなければちゃんと出るで

学習元がチンコでにくいモデルだと出ないかもしれんが試してないからわからん

>>559 サンガツ直ったわ

他のモデル選ばれたのにUI左上のモデル名は元の7thのモデルのままやったせいで狼狽したわ

>>525 このシンプルマージって両モデル0.5でマージするって事で良いのかしら?

追加学習の解説の画像

正しくはこうだと思うんだけど違う?

Emotion-Puppeteer

https://civitai.com/models/4940 手だけに特化とかㄘんㄘんだけに特化とかそういったの今後も増えそうね

新しくなったwebUIではLoraのsafetensorsはどこにいれたらええんや?

生まれて初めてPC触ったようなレベルの質問にも答えてくれるからね

優しすぎだろ、chatGPT扱いだよ

初歩的な質問ですまんのやけど1280×1280で生成すると手指や下半身が融合したりぐちゃるのはどうしようもないんやろか?

多少でも改善する方法あったら知りたいのやけど

数打つしかないんかな?

>>554 いた!ほんまサンガツやで

マジに花札のマークやな🎴こんなん

>>571 画像生成の質を改善するには、生成する画像の解像度を高める、トレーニングデータを増やす、モデルのアーキテクチャを改善するなどがあります。手指や下半身が融合する問題は、トレーニングデータに十分な手や足の画像が含まれていないことが原因の可能性があります。

chaggptちゃんが返事してくれたで

>>571 その程度でグチャる場合はプロンプトが無理な要求しちゃってんだな

AIが困ってしまった結果や

もっと通りやすい体勢にするしか

>>571 今のモデルは基本512*512で訓練されてるから高解像度ではだいたい崩壊するで

だから高解像度は直接設定するんやなくてhires.fix使うんや

使ってての話だったらそういうもんや基本ガチャやで

ハイエンドグラボで直接高解像度の描いても質上がったりしないんか?

>>578 当たりは出やすいけどディテールが足りない

latentのハイレゾは描き込みを増やしてディテールを盛るからキレイになる

直出しは物足りない

笹木LoRA作ったけどパチモンやな

>>578 関係ない

単にhiresが速い、ってだけ

>>563 ワイは0.5でマージしたわ

>>578 🤖は基本512の範囲内に描くものだと思い込んでるから

それが768くらいまでなら融通効かせてくれても1024とか2048とかになると2人とか4人とか勝手に描き始めがち

paperspaceの永続ストレージの容量とかってどうやって見るんや?

赤ちゃんに教えてくれい

右上のアカウントアイコンクリック→team なんとかクリック→Storageタブクリック

>>584 サイドバーとかにはなさそうだから

!du -hls /storage/

とかちゃうかな

>>555,561

サンガツ

Loraで学習し直すわ

ワイ(ガチの無知)

git pullしたらlaunch.pyの180行目にインデントエラーがあるからとアプデを拒否される

chat GPTに解決法を聞いてからブログを読むとgit stash saveすると直ると書いてあるからこれ実行し別のエラーを起こしてアンマージファイルがあるからとgitpullを拒否される

その後またchat GPTにgit add -uやれと指示されたのでやったら無事アプデと起動した模様

これは正解やったんやろか?

>>565 そんな大掛かりに線の引き直しするよりgradient updateって言葉の部分を納得の行く別の言葉に置き換えれば訂正1箇所だけで終わりそう

>>578 質は上がるで

めちゃ綺麗な絵出るからそれでガチャする人もおる

まともな人体が出ることはほとんどなくなるからやっぱりガチャや

>>584 左下のここでストレージとかマシンの稼働状況見れる

ストレージは追加課金した時の最大値でしか表示されないから自分のコースの上限超えないように気を付けるんやで

ストレージ80%超えたらマシン落とした時に警告出る

>>587 サンガツ。ほんと容量だけ見れた

しかし素人には使いにくいなpaperspace

colabのがわかりやすいわ

>>545 コイカツでキャラ作ってi2iしたらどうなるんやろか?

昨日はキャプションとタグ付けだけして寝てしまったから早く帰って学習させたいンゴねぇ

>>560 そういうことや

適当なVAE適用して好きな色合い探求していけ

予定より早く新調したPCが届くようだ

それはまことに目出度いんだが2台目用のキーボードが届いていない

こちらは明日以降なので困った

今の無線キーボードは簡単に切り替えられるタイプではない

レシーバーの抜き差しというアナログ手段で今日は乗り切るしかないのか

電気屋かホームセンター行って安いキーボード買ってこいよw

今日だけならそれで乗り切ればええよ

長期的に複数台使うなら切り替え可能なのにしておくほうええけど

キーボードは物理的なスペースの専有がキツいからな

いろいろ答えてくれてサンガツやで

今の設定やと100枚生成して30枚くらいしか身体がまともな絵が出来んのや

プロンプト見直しつつ試行回数増やしてみるわ

loraとか強めると指が破綻するのを大正義bad_promptでねじ伏せてるけど他にいい方法ないんかな

ワイクソ雑魚マカー

日々の生成でえげつない勢いで SSD 寿命を消耗するため Paperspace への引越しを考える

>>599 hires fixを使って出したまともな高解像度画像よりも

その3割以下の確率でしか出ない非hiresの高解像度の方が衣装や背景の細かい部分を描き込んでくれてるという理由であえてそっちを追い求める宗派も根強い

モデルによっては、ハイレゾ使う前の方がアニメ・エロゲテイストになっていて好き

あると思います

paperspaceでp5000借りてLoRA学習に手付けたで

としあきwikiの手順を参考にしてやったら学習のコマンドは成功してlast.safetensorsが生成されたで

wiki通りにいかなかった箇所を覚えてる限り書いとく

当たり前のことを知らない猿向けやから雑なのは勘弁してくれや

・mk dirのディレクトリ作成コマンドの間にスペースが入っていてエラーになるのでスペースを取る

・accelerate launchコマンドのパラメータのtrain_batch_sizeは8だとgpuメモリ足りないエラーになるからエラーになるなら1にしとく

だいたいこんな感じやな

発生したエラーはchatgptさんに解決方法を教えてもらって対応したで

hires.fix 2倍でヘソ増えるのって対策無理なんか?

ハイレゾ使うと絵柄変わるときあるよね

条件は分からない

>>605 lamaで消せばええやん

最近有志がwebuiにextension追加しとったで

へそが増えるくらいならInpaintでも簡単に直せたなワイの場合は

そもそも増えないように出力する方法なら知らん

>>599 全然打率高いやん 全く問題ない

まあ1200サイズ以下なら直出しでもそうそう崩れんからな

これが2048以上だとプロンプトにもよるが

200枚生成して当たり5枚以下とかが普通の世界や

>>599 Latentでその打率ならようやっとる

消すのはlama一択やな

あのUIでついでに指とか直してくれると最強なんやが

>>607 素晴らしい!

>>605 同一シードのストレングス0.01刻みでガチャれ

それか単純にガチャれ

多指に関してはlamaぶち込んどけばなんとかなる

少指はinpaintで頑張れ

>>582 サンガツ

出先から帰ったらマージしてみやう

30%くらいの打率でマシって言われると逆に衝撃や

みんなようやっとるわ

絵を描くのとは別の根気がいる世界やな

>>617 試しに今使ってるプロンプトを最大サイズまでアップスケールしてみ

プロ野球感覚でやれるならマシよ

ソシャゲガチャみたいなもんだわ

>>589 launch.pyが何か更新かかってて蹴られてるんやから

git checkout launch.py ってしてから、git pull するのが普通の手順やないか

まあ動けばなんでもええんやけど

PC届いてキーボード付属してた

それとは別にグラボ搭載機って事でマザボ側のHDMI端子にシーリングされてて使わないようにってなってるんだけど、

グラボの能力を生成や学習用途に全振りするためにはマザボのHDMIに刺す方がいいんだっけ

いきなりそれをやると映像出ないのかな?

シールはがすのなんか気が引けるからまずは3060のHDMI端子に繋ぐべきなんかな

こんなところからして躓いてて先が思いやられる

>>622 シーリングされてるのはボードにグラフィック機能がついてないタイプやからと思われるで

>>622 いきなりそこまで細かいところ気にしなくても問題ないかと

まずは普通に3060に繋いで使うのが無難だよ

オンボ運用は動作も地味にカクツクし、いきなりそこまで厳密な速度まで詰める必要もないとは思う

>>622 bios(UEFI)でCPUのグラフィックがオフにされてる場合もあるから、そこは出荷設定がどうなってるか次第

CPUがKFモデルやとグラフィック機能が無いし

まずは3060で起動かけて一通り設定かけて、それからbiosの確認やね

アップスケール2倍は運ゲー要素強すぎてあかんな

1.5倍でstep上げるか

>>623 >>624 ありがとう

わかる人には常識なんだろうけどグラボ初体験なんでマジでわからんかった

搭載CPUとしてはグラボ性能持ってるはずだけどショップが気を利かせてくれてるんだろう

ビデオカードあるのにMB側端子に挿して映像でないってクレームが結構あったせいでシーリングされるようになったらしいな

>>629 そこまでわからんレベルなら、最初は小難しい裏技みたいなのは無視して「普通に動いた!」っていう成功体験まで行くのが、精神衛生上も良いと思う

みんなありがとうです(汗)

CPUはi5 12400

そこに3060の12GB

電源コード繋ぐ以前の段階でこれですよ・・・

グラボのファンって外からは見えない事に戸惑ってるし

とりあえず今のPCと同じようにホコリ侵入防止のために換気扇用のホコリ取りフィルター貼りつけたいけど空冷の事を考えるとしないほうがいい?

グラボの冷却とどっち取るかやろ

専用じゃないフィルターは高確率で箱内窒息するし

>>635 こまめに取り替えないと空気の流れを阻害するだけだよな

なんならケースの蓋開けっぱなしにして蓋の代わりにフイルター貼ってもいいぞ

SSDの消耗ってそんな危惧するもんなん?

20年の寿命が10年になるとかやったらどうでといいんやが

完全に新品なら2週間に一回くらいエアダスターで定期的に吹いた方が早いしキレイな気がする

>>634 基本はそのまま使え

それでCPUやグラボが熱を持つようなら対策を考えるんや

下手にファン付けたりするとケースのエアフロー(空気の流れ)が乱れて余計悪化する事もあるで

まずは使ってからの話や

20年の寿命が15年になるくらいだからどうでもいいよ

3年持てばいいよ

どうせ5090で丸ごと買い替えだし

私事で恐縮やが10月末に買ったBTOパソコン

横がガラスなんやが最近グラボ傾いてる気がして測ったら

前と後ろで6mmも垂れ下がってたわ

グラボ用突っ張り棒入れて解決

重たいグラボの人は気をつけなあかんで

>>545 > 二人以上のキャラ学習して同時に呼び出し

試しにLoRAでやってみたことはあるけど

姿勢とかどれだけ調整できるかはちょっと分からない

CPUファンも空冷の重いのだとマザボが少し曲がるとか聞いたことあるな

>>633 サンガツ

後で貰うで

最早完成されてるように見えるが、まださらなる向上を求めてるのは完全に探求者の域に入ってるな

>>643 上のHDDケースから金属フックで吊ってる

下から支えるよりスツキリするのと倒しても転がらないので

336mm あるからね

基板折れるよ

>>643 PCDep〇やD〇SPARAクラスは論外だけど、Fr〇ntierあたりは動けばいいって感じで、付属品も解説もついてないしSSDのねじ締めすぎで山潰れてねじ外せなかったり結構ひどいことはある。サポートにも連絡してもそんなことはないとか動作に異常はないんですよねって蹴られる有様

重量級のグラボにはバーがある構成選びたいねぇ

>>650 ワイはこれの下から押し支える奴をつこうとるわ

あるとないとでは安心度が違うわな

>>633 サンガツ!

4枚目の子好きや

ありがたく使わせて貰うで

>>644 タグかキャプションつけて学習させないと、だよね?

インシュロックでグラボの端とケースを結んで吊るというテクニックがあるらしい

webUIアプデしたら前のバージョンで作った絵をPNGinfoに入れても微妙に違うのが出てくるようになったな

絵柄がごみとか破綻してるとかではないんだけど…

最近GPU負荷かけるとGPU辺りからカラカラみたいな音が鳴るようになりはじめたやで

なんやこれ

>>656 ファンにたるんだコードでもたまに当たってるんちゃう

そもそも音が鳴るのは99%ファン周りしかないし

chatgptのオープンソース版でたらしいけど、どう?

元のやつ有料化するらしいし、誰かAI画家特化させてくれない?(他人頼み)

>>656 ワイも鳴るわ

GPUか電源か知らんけどしばらくカラカラ鳴ってそのうち鳴らなくなる

>>656 ワイのファン異音なり始めてからすぐ逝った

寿命だったわ

水冷化キットとかつかってファンそのものを無くすとかはよくある

>>663 できんことはないが、分解になるのでメーカー保証切れるわな

つかメーカー保証あるならそっち使った方がええ

バラしてファンに書いてる型番で検索したら尼で売ってたりするで

ファンからの異音は故障の予兆やから注意するんやで

わーいPC起動してwinのセットアップおわったー

モニターはTV(レグザ)に繋いでるけど、発色とかがPCのモニターより良くて困る

さて、PyTorchやらAutomatic1111について一から理解を始めんとな・・・

CUDAってなんやマジでわからん

ひとつずつダウンロードしていけばいいのか

>>667 Nvidiaの最新のドライバ入れたら、あとはPythonとGit入れて導入するだけ

基本的にそれだけ

昔はcuda環境つくるのにえらい手間だったけど、今はドライバとtorchインストールで全部やってもらえるんかね?

>>668 ありがとう、やってみる

すでに疲れて来てる自分がいる

焦らずのんびりやりますかね

しかしみんなこんなややこしいもんよくやってるなすごいわ

>>663 中学校レベルの技術と理科の知識があればできるが…速めに異音がするって保証期間内に新品に交換してもらうのがいいよ

やっすいマイナーなグラボだと中国の変形ファン使ってたりするので財力とガチャ運も必要になるし

中華QQもLoRA完全移行してて草

TI、HNとはなんだったのか

>>670 なんも分からんでもマジですぐできるで。アホアホワイができたくらいや。

Python入れて1111入れるだけや。wikiの導入にはnovelaiのリークモデル落とすとかいう手順もあるけどハローアスカするだけのもんやからすっ飛ばせばいい(wikiにもそう書いてるけど)

1111入れたら後は好きなモデルハギングフェイスから持ってきて終わりや。後はシコれ。

https://majinai.art/i/_i7jAoR https://mega.nz/folder/lPh0FIrQ#P7DUXRygu6ZV84-HcpPExg 授乳部のもんやが全然うまくいかんから簡単そうなやつ作った

トリガーワードはchinmekakushiにしたつもりなんやけど全く効いてる気がしない

先頭に入れて4トークン保護したらそれで呼び出せるわけじゃないんか?

キャプションなんにもわからんわ

penis over eyesを強化するLoRAと思ってや

sd-script0.4.0製だからsd-additional-networkの最新版必須

>>671 先入観無しでこれ何?って言われればキノっぽいけど、キノだって言われると似てるけど微妙っていう…

サンプルはワンピースに似てる画像も多いけど主要メンバー揃えるのでかなりのチェリー・ピッキングしないといけなかった

ナミとウソップとチョッパーに至っては似てるってところであきらめた

https://civitai.com/models/5066/eiichirou-oda-one-piece-style-lora TIはなんだかんだまだ役割を持てる

HNは厳しいか

>>670 基本は9月のまとめから変わってないというか最新版Python 3.11は入れちゃダメなくらい

3.10.xを使ってインストール時にPATHを通すにチェックを入れる以外はひっかるところはないと思う

技術系は手を抜かずに基本通りやることが重要、楽をした分しっぺ返しが来るからね

今のところLORA放置してHNで遊んでるけどそんな流れなんか

絵柄もいける話は見るし学習環境の導入考えんとなあ

(bad prompt:1.4)を(bad_prompt:1.4)みたいに

半角スペースをアンダーバーにして強めにかけると絵が壊れることに気づいた(作者の推奨は0.8)

ただ、これはこれでいにしえのゲームみたいな味がある…かもしれない

waifu出た辺りから忙しくて浦島太郎とかいうレベルじゃない程浦島太郎なんやが勉強させて頂くンゴ

>>653 ああごめん、キャプションじゃなくてインスタンストークンを使ってる

2キャラの同時呼び出しはこんな感じ: 2girl, sks 1girl, shs 1girl

たしかに4chan のLoRAとやり方が違うしね……

学習はkohya のインストどおりだけど、4chan とどう違うんだって話なら

>>256 かな

組み合わせて使えるようになったから尚更飽きなくなくなってしまった

>>657 サンガツ、ワイこれがないと学習出来ない体になってしもた

>>676 お陰様で一人で二人を相手する構図が安定したわ

偶に目隠しもしてくれるので美味しいです

webuiアプデしてlora使えるようになったでー

世界がひろがりんぐ

>>676 マジナイの「AddNet Model 1」のところに

ちゃんと「chinmekakushi(e7b86560)」と書いてあって笑った

こういうのも表示されるんだね

無知無知すぎて何を調べればいいかすらわからんのやがloraやらHNとやらをなんやかんやするんか🧐

ぶっ壊れアンドロイドと四肢切断LoRAの相性がめちゃいい

※ややグロ Basil&Elysium

ていうか他の実写系モデルでも普通に達磨少女が出て感動した

すごいぞLoRA

>>683 HN、TIの学習でよく見たやつwww

もはや半分トラウマの絵柄

>>683 3枚目のやべー世界に連れて行こうとするタイプの怪異感よ

aiが良くわかってないけど何とか頑張って書いたときの絵がこんな感じな気がする

>>683 loraの学習開始しようとすると、画像がありませんとか言われる

画像データ配置してその場所もオプションで指定してるのになんで…

なおワイ機械学習初心者

webUIアプデしたら色んな学習データのリンクがぶっ壊れたので再立ち上げしたら

今度は前まで使えてたextensionがエラー起こしまくって

「ニキたちに質問するために色々スクショしてちゃんとまとめるか」とかやってる間に

念のため再起動してもう一度走らせておいたらなんかうまくいっている

わかんないけど動いてるからヨシ!

>>683 ちなbad prompt v2とbad prompt version2とbad-prompt-v2とbad-prompt-version2と bad_prompt_v2とbad_prompt_version2で効き方違うからな

handとだけいれて生成確認してからいれてけ

因みにおすすめは(bad_prompt_v2:0.2)

>>698 数字_○○ のフォルダが見えるように配置(つまり1つ上のフォルダ指定)やで

>>698 画像のフォルダ直接じゃなくてその一つ上のフォルダ指定じゃなかった?

なんかフォルダの置き方決まりがあったはず

>>517 打率30%でマシいうても

失敗作の中にもキラリと光る部分があって面白いのがAI絵やからな

拾ったlora使っててアニメ調で学習してるっぽいのってどのモデルでもアニメ調が出る気がするんだけど

これはアニメ調の画像を学習してるからって事なのかな?バジルでそのキャラのリアル調を出して欲しいって時は他形式の方がいいのかな?

>>702 >>703 ありがとう😭

危うく日が暮れるところだったわ

>>705 本来はそうなんだけど、2Dで学習したLoRAでもNAI遺伝子が入った実写系モデルだとわりとそれっぽいコスプレな人は生成出来たりする

basilでもそこそこいける

ただし0.5とかに下げないとキモいかも

>>683 bad promptをネガじゃないプロンプト側に入れるとえらい事になる

>>701 これってファイル名をプロンプト上で指定しとるんやないんか?

拡張の「seed travel」でアニメーションにしといたから心が不安になるビデオとして活用してくれ

https://imgur.com/LeYz8qS >>701 おぉ、version2じゃなくてv2でもいいのか

それは試したことなかったから色々実験してみるよ

lora学習初めてできたけど拡張のAdditional Networksでローカルだと適用されて生成されるのにpaperだと選んでも未適用のまま生成される

誰か知恵を貸してくれ

>>686 見てみた。

インスタンスベースで2キャラ学習するなら

chara/sks girl

chara/scs girl

学習フォルダはcharaとする感じ?

繰り返し回数をその前にいれるんかね?

繰り返し回数がイマイチわからんのよね

>>683 TIってファイル名がトリガーで効くから最初のやつはTI読み込めてないだけじゃないの?

それともTIのファイル名でも変わるってこと?

>>712 paperspaceの方のAdditional Networksは最新版?

ワイも同じ症状やったがアプデしたらなおったで

>>717 見た目は同じだけど違うんか、一回消して再インストールしてみるわ

こんだけ超速で色々進化してる中で普通に使われ続けてるbad_promptという奇跡

bad系は入力するとき面倒だからファイル名ba、baa,bp1、bp2にしてるわ

みんな学習を使いこなせててすごいな

俺なんかwikiでloraの導入手順を流し読みして理解できずに無理だと諦めたぞ

>>711 それはファイルのリネームもひっくるめてだし…

スペース区切りは別単語だから効き目が違って当たり前で、HNのトリガーにすらなってないし

先週までの古い指定だとHNの画風というか全般適応がかかる

毎日アップされるloraで遊んでるだけやわ

まだ効果よく分からんのもあるし

>>721 一度やってみたらええ

書いてる事が判らんでも、やってるうちに覚えたりするしな

試してたら普通にリアル調の出た操作ミスか勘違いだったみたいです

なんかpaperspaceめっちゃ借りれるようになった?

A100もA6000もこんな空いてなかった気がするんやけどな

>>689 使えたならよかったわ副作用でhandjobの効きがよくなる気がする

種付けプレスLoraとちんぽ目隠しLoraうまくいってるニキの作品が見たい

Paperspace民のワイ、画像生成の手を緩める気になれず、学習にまで手が回らん

学習用にもう一つ環境が欲しいわ

paperspace、colab、kaggle、studio lab

全部使えば常時2環境以上動かせるで多分

ワイもそのうちやる予定

ワイも種付けプレスしたいんやけど

mega.nzのファイルってpaperspaceからどんなコマンドでダウンロードするんや?civitaiはwgetに変なオプション付けたら行けたけどググっても出てこんわ

>>728 50回ぐらいやって1回だけ成功してから全くやってないわ

>>730 colab民ワイ、6アカウント使い回して常時稼働

今Kaggle環境までAI絵のために使われとるんか...確かにT4使えるからVRAMはそこそこあるけども...

コンペ良く参加するから複雑な気持ちや。(AI絵と関係なしに)しょっちゅうGPU環境混雑しすぎって燃えがちやし

一体何をそんなに学習してるんや

ネタ尽きないのすごいわ

>>731 なんかpaperspace自分のPCから直のドラッグアンドドロップでのデータアップめっちゃ早くなってるから

めんどうだったら直置きでいいんでね?

Loraランダムっていけないよね?

conceptとかdynamic promptに組み込みたいわ

>>733 こら😡

並行で使ってもBANされんのか?🤔

>>738 一時期colabで6アカウント使ってたけど特に何もなかったな

今は面倒やからpaperspaceのproやな

>>732 あかんか

性癖loraもなかなか難しいわ

なんかgpt厳しくなってないか?伝統的風習や文化多様性を駆使してもレッドカード出されるんやが……もうこの手は通用しないのか

>>735 既に終わった過去の作品とか学習させたいものはいくらでも出てくると思う

特に90年代の昔の作品とかマイナー作品とか

LoRAがあれだけ短時間で学習終わるんだからChatGPTちゃんがこの短期間に

ワイらのスケベハック対策してきても何ら驚かんで

>>735 人間がエロを追求してどれくらい経過したと思ってるんや?

エロに終わりはないんやで‥

同人ゲーのキャラクターとか学習させたいが公開は躊躇する

>>743 リリース以来ケモ要素追加以外のアプデロクにしてないNAIちゃんと違ってChatGPTちゃんは勤勉だなあ

崩れた手の画像はちょいグロ画像なんで貼らないけど

実験してみたら確かに半角スペース「bad prompt」だと効いてないね

ただ、効いてないもののAIマジックで偶然?改善される場合もあるから

自分みたいに勘違いしたまま使われているって感じなのかな

投稿系だと半角スペース「bad prompt」も結構あるから注意したほうが良さそうだ

また1つ賢くなっちゃったよ

ちなみに、普通のプロンプトだと(bad finger)と(bad anatomy)の組み合わせが比較的良かった

もうそっちオンリーでガチャったほうがいいのかも

忘れたり見落としそうだし

画像集めたは良いが学習に邪魔そうなの仕分けするのしんどいな

まだ地獄のタグ精査まってるんやろ

embeddingsのファイル名がbad_prompt.ptならアンダースコア外したら効かないでしょ

読み込まれないんだから

>>751 何がやりたいかによるけどこだわらんならLoraはwd taggerで自動タグ付けするだけで十分やで

LoRA導入難しすぎて笑う

automatic1111余裕だったから大丈夫だろと舐めてたわ

皆頭いいな…

最新のWUIだとどのembが読み込まれてるか見られるからそれで判断できるはずや

>>753 それだけだと構図系タグ雑だから直してどうなるか確かめたいんよな

badpromptはファイル名通り記述してるか

それだけよね?

難しいというか、エラー出てしまって放置してるわlora

手探りで更新した結果エラーがドバーっしたから最初から入れ直したわ

次からここで赤ちゃんになる…

launch.pyのエラーってことはwikiに載ってる高速化の書き換えした時になにかやっちゃったんやろなぉ

NAIとBASILmixのマージが学習モデルにええようやって噂になっとるようやね

ハイレゾの仕様変更前からwebUIアプデしとらんのやけどアプデしたら生成速度落ちるんかな?

同じ画像は出なくてもええんやけど速度が気になって

>>758 他人のlora使えるやつだけでも入れといたほうがいい

>>758 人様のを使う分には何とかなるから挫けるのよね

神が学習GUI作ってくれるのを待つわ

多分ワイも高速化でやらかしてる

一時期20it/sまで落ち込んで色々いじって30it/sに戻ったから

また最初からやり直すと遅くなるんだよなあ

>>754 導入自体はうまくいけばautomaticとそんな変わらん難しさやと思う

環境によってエラーが出るんが問題なだけでいろんな導入方法探したらいけると思う

>>728 latentすると消えてしまうちんぽ

学習素材katanukiした時に男消しちゃってたのがよくなかったな

>>750 >>750 みんなが言ってるbad promptってTIのことだからファイル名一致してないと意味ないぞ

NPになんか入ってるから違いは出るだろうけどそれはbad_promptちゃう

bad_promptってハイレゾかますと効果なくなるよね

雰囲気でそう感じる

>>765 色んな体位作りたいから頑張るわ

>>767 NMKDの方?そっち試してみようかな

今更ながら4chlora覗いてたんやけど

データセット見たら結構背景残したまま素材に使ってるみたいで訳わからん

学習素材って背景透過したり白塗りにしなアカンわけちゃうんか?

ファイル名どおりに入れないTIでなんか出てきてるとしてらそれは一部を普通のトークンとして拾ってるだけやで

>>773 そうなんか、もっかい読んで勉強してみるわ

サンガツ!

embedding使いやすいようにリネームしてたんやけど問題ある?

バッドプロンプトはbp2にしてた…

>>771 背景透過の素材だけやとU-Netの一部の層しか学習されず汎用性が落ちる(らしい)

TIってのは要はファイル名と同じプロンプトを追加するんや

プロンプト・ネガティブにファイル名を書けば自動的に適用される

ちゃんと呼び出せていれば生成結果の下の方に Used embeddings: foo [bar] って出る

>>775 使う前のリネームは問題ない

中華TIとかファイル名に漢字混ざってて環境次第で文字化けとかエラーの元になるし

>>771 ちゃんとタグ付けしとけば全部分けて学習されるから問題ないんやと思う

結局白塗りにしたところで白塗りの背景として学習されるだけやしな

余計なものを入れないという意味では正しいと思うけど

まじないみると明らかにTI入れてないままbadprompt入れてる人とか結構いるで

studioLabだけ導入の情報少なくてようわからんわ

syaimuニキが7thの新モデルのテスト作ったけど5ch規制されたみたいで貼れないらしくて悲しいなあ

何か技術部の方でちょくちょく規制されてるって人おるわ

7th_v3-testAにめっちゃお世話になっとるんゴねえ

>>776,

>>781 そういうもんなんやね

txtファイル含めて公開データセットもういっぺん見てみるわ、サンガツやで

USBケースとSSD届いたからテスト環境構築しようと思うんだがすでにCドライブのユーザーフォルダに古い安定環境が有る場合って導入時に特別な注意点ってあるかな?

LoRAの学習ステップと途中Epoch生成でちと確認したいんやが

学習枚数100 x 繰り返し数100 x Epoch数10 → 生成数10 と

学習枚数100 x 繰り返し数10 x Epoch数100 → 生成数100 とは、結果同じになるはずよな?

だったら繰り返し数減らしてEpoch数増やした方が途中で生成されるファイル数が細かい確認出来てええ

最終結果だけ欲しいならどっちでも構わん

って解釈であってる?

種付けプレスの手足が安定しないから触手にしたけどそれでも崩壊しまくった画像しか出ないな

>>596 synergyの後継、barrierをインストールすると捗るぞ

学習がそもそもわからないんやが、たまに生まれる奇形が出なくなったり微妙に惜しい構図が正しくでるようになるってこと?

キャラクターは構図とかは覚えず特徴だけ覚えてくれるといいけどシチュエーションやプレイ内容は構図とかは覚えて特徴は覚えないのがいい

あちらを勃てればこちらが勃たずやね

>>795 そもそもそのモデルに存在しないポーズやキャラを追加出来る、という認識のほうが正しい

新しいLoRA全然学習できてないと思ったらextension更新してなかった

最近は画像作るよりもコードのエラーと格闘してるわ

>>714 繰り返し数は必須、それでサンプル(キャラ)ごとの比率も変えられるし

とにかくデータ量が少なくてもLoRAはそれなりに学習するよ

とりあえず

>>644 を学習させたときの数値を書いとくけど:

(このときのGPU はT4で、30分くらいで終わったはず)

フォルダ

src > 20_sks 1girl (8 images) , 20_shs 1girl (8 images)

cls > 1_1girl (16 images)

コマンド

--learning_rate=1e-4 --train_batch_size=1 --max_train_steps=1600

赤さんでも分かるLORA入門講座どっかにないかね?

>>802 学習は分からないけど使用だけなら一番新しい1111氏のwebui使ってstable-diffusion-webui>models>loraの中に拾ってきたloraのファイル(大体10何メガかのsafetensorsが多い))を入れてuiを起動ジェネレートの真下の赤い資格のマークをクリックスルトタブがでてくるからそこからloraを選んでプロンプトが入ったら成功でいいと思う強弱はそのプロンプトの右側の1を他の数字に変えてつける

ただloraはそれ用の呼び出しプロンプトがあるみたいでそれらをプロンプトに入れるとより精度が上がるみたい

4chだとloraは「エポック1にして学習画像のリピートでステップ数稼ぐ」

らしいが、どういうこと?

loraってフォルダ名の数字がリピート回数で

(1 epochのデータ数が「学習用画像の繰り返し回数×学習用画像の枚数」となります。) だから

繰り返し回数を増やすのもエポック数の数字増やすのも学習する回数増えるから一緒じゃないんか?

>>804 epoch切り替わりのタイミングで謎の待ち時間が発生する仕様なので時間短縮のためにそうしてるんじゃないかな

学習結果の違いはわからん

Zipang1.4作るために、Zipang1.3+no_zipangを0〜1.0でマージ回してみた。

やっぱりなんか癖があるんだよなぁ…basilと混ぜたほうがえぇんやろか…

ふと思ったんやがloraで頑張れば簡単に竿役をショタにできるんかいな?竿役になった途端にムキムキマッチョになるからどうしたもんかと思ってたけど

>>805 あなる

待ち時間ってあれか、人間も寝てる間に学習するみたいな

>>779 まあ過疎化して停滞するよりは良い事や

やる気のある未来の有能が混じってるかもしれんからな

同じキャラで学習率変えたLoRAを3つぐらい適用させたらうまくいった

何かに使えそうな技術だな

>>779 順調にAIが浸透していっとる+

どんどん高度化していっとるからついていけなくなっとる証拠やわな

正月に頼んだパソコンやっと届いたけど-6℃の気温でヒエヒエや

結露でいきなり壊れたら辛いから一晩寝かせるで😣

>>814 寝かせるほうが怖い

むしろ一晩中生成しようぜ

>>693 おお同好の士

ワイも四肢切断LoRAとアンドロイドの組合せには可能性を感じとるんやが

あんまりやり過ぎるとグロ画像になるんで表に出しにくくなりそうなのが難点やな

(ややグロ)

フォルダ全消ししてgitbashで最初から入れ直そうとしたら

今まで無かったエラー出て進まなくなってワロタ

chatGptに聞いても検索して出てこないエラーなんで

赤ちゃんインストーラーに頼るわ

ワイボケてきたのかもしれん

赤ちゃんだから最後にnetworkオプション足すのにつまずいたわ。。

とりあえず学習はじまた。

それとは関係なく過学習したlora適用して関係ない画像出したやつ

色々モデルは出てるけどAnythingみたいなマージのメイン素材にぴったりモデルって出ないな

Lamaのextension探しても出てこんのやけどどこに転がっとるんやろか

男の体がちゃんと出て体位を増やすセックスモデルがあれば・・・

>>818 今更新したら動かんてissuesに書き込まれまくってるけどそれかな?

>>817 いいね!!!

今まではどうしても手足が取れてくれなくて困ってたからLoRAさまさまよな

何よりアンドロイドは手足が無くても納得のいくシチュエーションてのが作りやすい

ネタかぶってもいいので次作が出来たらまた貼ってくれ

Hires. fixのUpscaler設定どれ使ってます?

比較サイトもなさそうでどれがいいのやら

雰囲気でやってるから今までbadpronpt呼び出せてなかったわ

ずっとlow qualityとworst qualityだけで生成していたらしい

>>826 主に選択肢は

>>422の【】3種だと思っていい

その中のどれにするかはあんまり変わらない(どうせ拡大処理して終わりじゃなくそれ+i2i的な再描写処置をするので)

つまり大別すると

①リサイズ・リサンプル系(最もhires無しの元絵に近いものになる)

②超解像系(綺麗に引き伸ばすがちょっと線が太いとか塗りが平面的になることも)

③Latent(再描画しながら引き伸ばす、細かい描き込みをしてくれるが化け物も産みがち)

の三択

>>819 雰囲気でやってるからか、学習量が足りないのか全然だった。。正規化画像がイマイチだったか。。?

latent以外だとAnime6Bもかなり良いUpscalerだから試してみてくれ

>>824 そんなんあったんかサンガツ

git pull何回かしたらとりあえず立ち上がったんやが

試したら今まで見たことないrealisticなハローアスカ出てきたで

今まで何回もインストールし直して初めてやでこんなん

>>547 ホンマにありがとう

参考にさせてもらいます

マジでありがとう

なるほど、ありがとうございます。

3060なんで時間的に全部は厳しいので

いくつか絞って試してみます

エロ画像しか作らないからわからないんだけど一枚絵ってそんなにハイレゾするのか?

ほとんど768*768にしてるからハイレゾあんまりやったことない

一人だけ映るイラストなら

512×768を2倍にアップスケールしてる

どっちも50STEP

>>837 フルHDにして壁紙にしてみたりとか

縦長にしてスマホの待ち受け用にしたりとか

ってのをやり始めると沼

10連ハローアスカ、前より少し遅くなったけどもうこれ以上イジるとまた動かなくなるからこれで我慢して使うわ

>>837 どのくらい変わるか試しにやってみるかの

やっぱり女装らしさを出すなら短髪にしたほうがいいかもしれない

はじめてガラス蓋で中身見えるやつ買ったからワクワクして観察してたらCPUやらクーラーやらグラボその他金属部分みんな結露して水滴あるんやが😣

これ明日まで放置して乾燥したら大丈夫だよな?

もし壊れてたら初期不良なるやろか

ワイまだ箱から出すことしかしてへんのやが

>>837 ハイレゾが向いてるものと向いてないものがある

エロはどうやろなぁ・・・

顔が崩れるようなやつはハイレゾでしゃっきりやぞ

ハイレゾ使うだけでめちゃめちゃ画質変わるのに

ハイレゾ外すときって特殊性癖LORAが崩壊するときしかもはやないわ

>>837 PCのモニターが2560x1440でスマホが2400x1080とかだからな

壁紙にしてホクホクするならそれ以上かなるべくそれに近いサイズで出したい

512x512とか768x768とかはサムネイルとかわらん

>>829 そもそも後付でファイルもってこなあかんってさっき知ったわ。なんもせんでもそのまま文字打ち込めば効果あるんやと思ってたで……

>>848 waifuはESRGANほど元絵を改変しすぎないってメリットはあるけど動作はずっと遅いしwuiに組み込まれてもいないから敢えて使うほどでもない

ワイ、ギットプルしてもエラーが治らんため遷都

生成の下にあるsave style ってどこに保存されてるかわかる人おる?

>>850 webui-user,batとおんなじとこにある styles.csv やろ

>>850 webui直下のstyles.csvにある

高解像度でエロ画像作ってみるか

頭赤ちゃんよワイは1111のアプデはまだ待った方がええか?

2キャラ出来たけどそれぞれ一人ずつ呼び出すとある程度いいんだが、二人同時だとイマイチだー

正規画像かな、原因

最近初めてHNに手を出して好きなキャラ学習させて満足しとったんやけど

LoRAはもっとすごい世界が広がるん?

そういやstable tuner?とかいう学習法のはどうなってるんや

世界樹ニキのDBまんま使って学習元丸わかりなイラストをpixiv上げてるアホいて草

ちょっとは隠せや

マジで日進月歩どころか分進時歩で2日スレ見ないだけで浦島やな

>>851 >>852 サンガツ!やっぱり呪文はメモ帳とかに取っとかないとあかんな

STは専用モデル作るときに使ってるわ

ただ今はLoRAの学習が3分位で終わってかつ精度まあまあ出るからLoRAで遊んでる

超初歩的な質問ですみません

bad promptをautomatic1111で使いたいと思い

bad prompt version2のファイルをダウンロードしたのですがどうしたら適用できるでしょうか?

ST(StableTuner)はSTで使ってるよ

学習させてから階層マージさせたり、ST-元モデルの差分をLoRAで取り出したり

LoRAで学習させたものより差分LoRAの方が出来が良かったりするのは、LoRAのチューニング不足なんだろうなぁ

Twitterとブログから紹介されて流入しとるしな

>>861 別に高くないで45%や

ただ外気温がマイナス6℃だっただけで

>>856 使い方はHNで再現度はDBって感じやな

いいとこ取りや(導入の敷居は除く)

>>863 huggingface.co/datasets/Nerfgun3/bad_prompt

Usageに書いてありますん

>>868 ググると「注意!宅配家電の即開封はNG!」なんて記事が見つかりますね……

起動はよく乾燥させてから

前はダメやが後ろはOKって

宗教の影響ありそうやな

1111氏ずっと更新してるね

何が変わってるのか正直よく分かんないけど

>>871 わざわざありがとう

朝のワイが知りたかったで…

一晩と言わず2~3日くらい乾燥させとくかな

majinaiとかで見るBatch posってどこで変えるんや?

settingsとか見てもそれらしい設定見つからんし...

>>869 実はDBで先にキャラ学習させたのがイマイチ(過学習気味?)だったので、HNに手を出したんや

まあ次に何かを学習させたい機会があったらLoRAも候補に考えてみるわ

サンガツ

bad_prompt入れたら何かサイケデリックな厚塗り化したから外しちゃったんだけど、みんなアレ使いこなせてるんか?

中田市しない膣性交が聖書的にNGだからアナルで

とかいうよくわからない理屈があるらしいで

生足フェチ部だったけどあまりにも生足生成が安定しないから今日からハイヒール部

>>878 もうあんなん使ってる人おらんよ

指破綻とかあとから治すかガチャで良いし

🍀の連中はなんで🤗使わないんや

MEGAとか🎈ロダやろ

>>386 >>547 おかげさまで上手くいったっぽい。

昨日RTX4090ポチらなくてもまだ生きていけるかも。

助かりました。

>>870 親切に教えて下さりありがとうございました!

ここのスレの皆様のような博識で親切な方々がいるから自分のようなやつでも何とか画像生成を楽しめています

返せるものが何もないから申し訳ないです

bad prompt普通にinpaint用として重宝しとるが...

kritaプラグインかますと更に便利に

>>878 ちょっと懐かしい絵柄になって楽しいよ

LORAで巨乳サイレンススズカ作りたいんだけどAIくんって胸のサイズによる服の変形とか理解できるんかな?

とりあえずやってみるか

>>837 こんなちゃんとしたアレが

同じシードだとこんな地獄みたいな事になってしまう

これがハイレゾや、素人は絶対手出したらアカンで

しかし今ちょっとやっただけでも時々こういうのが出るからついガチャしてまうねん

Paperspace でターミナル開こうと思ってらアカウントのアップグレード案内が出てきてターミナル使えねえ

Paperspace は無料でもある程度画像生成に使えるんだと思ってたわ

>>855 おめでとw

> 二人同時だとイマイチだー

自分はあまり質とか求めてないので、そのへんはもうフォローできない

ただそういう知見の蓄積ってすでにどこかにあるようにも思うけど

なんかbad_prompt使えないとか言うスレ民にt2iで使うと破綻するからinpaintせぇとか言う話、数週間単位でループしてる気がする

まぁ新陳代謝があるのは良いことや

>>181 片っ端からエロいの調べてるけど空中射精かなり良い感じやね

hires.fixで化ける

https://majinai.art/i/MQ0lwvw.webp 貼ってくれてサンガツ!

>>890 320*512から640*1024は成功するけど

1280*2048のハイレゾはそうなるから素直に拡大だけしてるわ

なんか調整したらいけるんかね?

>>891 無料で使い倒そうとするとある程度工夫必要だね

あと無料の単純なスペック比較だとpaperspaceは1660相当でcolabが3050もしくは2070相当だからcolabの方がスペックはいい

Inpaintでbad_promptの手ガチャをしてるつもりがスペルミスでただの無意味なネガティブトークンで手ガチャを作り続けた者のみが石を投げなさい

seed固定した状態で無限生成かけたやつも石投げていいぞ

>>895 ワイはなんとなくでやってるから偉そうなこと言えんが無理やね

わざと小さい画像にして情報量少ないとこからlatent頼みでクソデカにするか

1.7倍くらいの拡大におさえるようにハイレゾ前の生成をでかくするか

どっちかしかないかもしれん

前者は割とうまくいくときがあるが最初から完全にガチャや

後者は1024くらいでガチャして確変引いたらシード固定でハイレゾや

>>896 さっきまでよく分からなかったけど藻舞のレスみて Paperspace の画面見てたら何となく分かってきたわサンガツ

もう常にbadpromptv2を0.8前後で使っててその絵柄に慣れてしまった

つけてる効果があるかは不明な模様

こんな電力不足が予測される最中にコピー機して電気無駄使いするスレ民はおらんよな🤭

なるほど

bad_ promptは最初は使わずにInpaintで修正するときだけ使うのが主流なのか

bad_ promptを一発出しで効果あるとこまで強調するとver2でも絵柄侵食されまくっちゃうし

今日も1111動いてるよ

そろそろ休んで欲しい😭😭😭

くっそーやっぱ最新版にしてから選択してるモデルと違うモデル読み込んでるわ……どうも絵柄おかしいと思ってフォルダにモデル一つだけにしたら読み込みたいモデルをようやく読み込んだ。俺以外に聞いてないからたぶんおま環だろうけど勘弁してくれ

>>894 自己レスだがこれには笑ったで

どういう学習でこうなるんや

ふたばでbasilのAIスレ立ってるけど概ね好評なの草

普段は規制しろだの盗作スレばっか伸ばしてるくせに

ふたばってスレすぐ消えるから動向がさっぱり分からん

>>676 亀レスなんやが、ほんまありがとう。こういうのめっちゃ探してたんや。普段ROM専やがどうしてもお礼を言いたくてな

というかhiresの種類増えすぎやろ

latentひとつでもわけわからんでこれantialiasedやらbicubicやら

やんやねんbicubicてわけわかんなくてビクンビクンやわ

始めてChoromeで開いてるWebUIがアウメモで落ちたわcmdの画像生成は普通に動いてるがタブ開きすぎか?

>>676 今気付いたわ

4chanのちん目隠し全然機能してないから助かるわ

アップスケーラーもサンプラーもわけわからん

結果あまり変わらんわりに使用メモリは結構差があるみたいやな

1111の更新、xformersの再現性がどうとかに手が入ったみたいね

あの細かく毎回生成結果が変わるやつが改善するのか?

眼孔姦lora出来たンゴ

シンプルにグロもあるから見なくてええで

https://imgur.com/a/LbkSDzt 爆速で更新し続ける1111ニキはAIか何かか?

更新するタイミングが掴めんぜよ

>>430 遅レスだけど。サンキュー。参考にいたします

paperでLoRAエラーでまくってようやく学習できたと思ったら9MBくらいの画像生成に影響を与えないファイルができただけで

同じコマンドで学習もう一度しようとしてもエラー出るので、一旦諦めることにしたわ

もう少し簡単になりますように…

BalloonMix使わなくても脱糞LORAとかそのうち出そうだよな

早速bad_ prompt試してみましたが皆さんの言われているようにかなり侵食されますね。全体的にアニメっぽくなる感じなのかな

bad_ promptの有無で上のが下になって笑った

>>676 majinaiのpromptと合わせてガンガン生成できて助かる

sd-webui-additional-networksでLoRAを入れないと機能しないのは

wikiに書いてある最新版で作成されているからって認識でOK?

>>920 マジで一部のやつしか喜ばん性癖出てきたな

後ろから足コキLoRA作ってみたが画質悪かったり手足増えたり安定せんわ

これはマシなやつ

全く関係ないけどGPUでエロ絵作成てどんくらいの仕事なんや

490WのRTX4090ぶん回すと400Wくらい熱になるんか?

>>727 そのとおりだね

ダブル手コキ安定してる

>>930 えっ…違う意味で逝きそうだなこの男

>>929 元々初期の頃にAIに求められてたのがマイナー性癖マイナーキャラ好きの救済だからなあ

NovelAI時代にそう言うのが出せないと察して去っていった奴らも今なら戻ってくるかもしれん

>>930 ええな

この手の構図は感じてる男(ショタが望ましい)の顔も重要なシコポイントやったりするから要求レベル高いよな

>>928 そうやで

一応676にも書いといた

今ちょうどやり直そうと思って素材を一括katanukiじゃなくちまちま編集してるとこや

もうちょいいいのができる予定

>>676 これ全く効いてないんだけど、 extranetworkに表示されてる状態で<lora:chinmekakushi:0.7>のprompt指定で正しいよね?

>>932 竿役がふたなりの女性化するのにキレてfaceless_male強くかけ過ぎた結果召喚されたコナンの犯人や

さすがにそこの強調は弱めてテスト中

>>930 これはすごい

竿役をメインにして責める女の子とか評価点高い

乳首責めたり耳をペロペロかフーフーしてたらたまらんやろうな

男がちゃんと出るモデルマジで作りたいな

需要しかない

>>676 これは既存のちんこ隠しLoraと合わせるもんちゃうんか?

単体でまじないプロンプトやるとふたなりになるだけや

これやっぱ拡張子変えてくれんとLoraかコアモデルデータか分からんくなるな

管理が大変そうや

>>938 extranetworkてWebUIのやつやろ?

sd_scriptの新しいやつで作ったからsd-additional-networkの最新版必須やで

https://github.com/kohya-ss/sd-webui-additional-networks wikiのLoraの使用方法 使い方その1 WebUIに拡張機能をインストールして使う

https://seesaawiki.jp/nai_ch/d/Dreambooth-LoRA 初心者なんですが複数枚の画像でキャラの統一感出すのってみなさんどうしてますか?

服の模様とか髪の長さとか

現状ガチャ回すしかないのかな?

>>938 sd-webui-additional-networkインストールすればt2iの下の方に設定するとこが出てくるはずそこから有効にすりゃ効くよ

もしかしてみんなWebUIの本体機能でLoRA使っとるんか

最近の更新なのにバージョンアップしとるんやなぁ

ワイはPythonとかよくわからんからsd-scriptを0.3.2に戻すやり方がわからん

使う人はadditional-netoworkいれてな

1111のさっきのアップデートでtorchとxformersの推奨バージョンが上がったで

あー、最新版って1111の事かと勘違いしてた

ありがとうできたわ

>>947 sd-webui-additional-networkも最新web-uiのloraも組み合わせは出来るのは確認したが、割合がピーキーになるわ

はじめてLoRAの学習やってみたけど、

None of the inputs have requires_grad=True. Gradients will be None

って warning が出る

ツールはkohyaさんのsd-scripts

これは学習できとるんじゃろか

まーた再インストか

落ち着くまでしばらく待つかなー

>>948 これってlaunch.pyを書き換えなくてもRTX4000でxformersを使える認識で合っとる?

>>953 4000シリーズ対応版だったと思うで、cu117

4090は持っとらんので確証ないけど

torchはインストールできたけどxformersは--reinstall-xformers入れても

No module 'xformers'. Proceeding without it.

って言われるな

なんでや

やっぱ最新版追っかけたらあかんな

>>950 ワイもキャラLoRAと組み合わせたりしたけどいわゆる過学習っぽい画像になりやすくなるな

プロンプトとの相性次第でぐちゃることもある

HyperBreastsとか併用したいんやけどなぁ

torch 1.13.1+cu117とxformers 0.0.16rc425の入れ替えは起動オプション付けたら入る

ワイの所ではxformersでコケたが

手動でvenv内でpip uninstall xformers 、その後 install xformers==0.0.16rc425 ですんなり入ったけど

ちょい書き間違い、pip install xformers==0.0.16rc425 やったわ

あぷで後なんか遅いなと思ったらxformer死んでることあるある

再起動すると何事もなく復活するから原因分からんままという

どんなネガティブ入れても首から上がまた体になるクリーチャーが生まれるんやけどなんかいいネガティブない?

入れ替え後はこうなる

LoRAのキャラ学習は顔か衣装関連のタグ消して学習すればいいのはわかったけど体位の場合は何を消すんや?

あと次の更新でsd_scripts 0.4.0に暫定対応した模様

add support for loras trained on kohya's scripts 0.4.0 (alphas)

重い腰を上げてLoRAの学習に手を出した

適当にやっても結構再現できるすごいなー

>>957 すまん

>手動でvenv内でpip uninstall xformers

これ詳しく説明してくれん?どこでgit bashしてpip uninstallすればええんや

venv\でええんか\Lib\site-packages\xformersなんか

っていうかpip uninstallしてもcommand not found言われるし

調べてpy -3.10 -m pip uninstall xformersしても

WARNING: Skipping xformers as it is no installed.

言われるし

もう二度と最新版追わんわ

ColabでLoRAの学習ができなくて悩んでたけど

原因はVRAMじゃないほうのメモリ不足やったわ

4090なんだが、torchとxformers更新したらめちゃくちゃ生成遅くなったわ

アスカテストで32it/s だったのが 11it/s まで落ちた

これでは仕事にならん

venv消してやり直すか、今日は寝るか

BooruDatasetTagManager利用しようと調べてたけどこれVisual Studio入れてビルドしないとアカン?

kohyaニキすご

ワイも重い腰上げてLoRA学習するわ

今は怒涛の更新真っ只中だから下手にアップデートしないほうが良いよ

肉厚ベロすこすこ

>>966 venvの中に入るはvenvフォルダに入るという意味やなくvenvをアクティベートするという意味やろ

詳しくはググれ

Wikiにこの設定だとうまく学習できたみたいなページほしいな

venv消してやり直してもダメやね

11it/sじゃマジで仕事にならん

ハイレゾガチャ今の3倍の時間かかるんじゃ話ならんわ

AI利用だとCPUはインテルとAMDどっちがいいとかあるんかな

>>945 キャラの統一は学習が一番の近道ちゃう?

初心者で学習の仕方分からんならLoraなりTIなり先人が作ったもん使って良いしな

>>966 stable-diffusion-webuiフォルダでターミナル開いて

Winなら .\venv\Scripts\activate ←先頭の「.」忘れないように

wslなら source venv/bin/activate

と打てば、ターミナルの表示が(venv) が付いた状態になるはず

そこで

pip uninstall xformers

pip install xformers==0.0.16rc425

で入る

終わったら deactivate と打って終了

xformersのインストールで他のエラー出た場合はググって調べてくれ

更新直後は情報も少ないしな

有志の情報がまとまってからうまい汁吸っていけ

Linuxのほうを人柱覚悟で全部アプデしたけど生成速度は特に変わらんかった

torch 1.13.1+cu117

torchvision 0.14.1+cu117

xformers 0.0.16+bc08bbc.d20230124

ワイ赤ちゃん、kohyaニキのloraが対応すると聞いてウキウキな模様

これAUTOMATIC1111をダウングレードしてもtorchとxformerのバージョンは変わらんのか?

生成速度落ちたままや

もうアカン、ワイお手上げやで 寝るわ

>>990 もう別で環境作り直した方が早いんちゃうか?

loraやるかと思ったら1111正式採用待ちなんか

この更新が落ち着けばloraもkohya版も意識せずに使えるようになるし良いよな…

SHIFT+右クリックでターミナルを開ける事すらLoraのスクリプト使うまで知らんかったわ

torch: 1.13.1+cu117 xformers: 0.0.16rc425 に上げた途端、激遅になってもうた

それまでtorchとxformerはバージョンアップしてなかった

CUDNN 8.7はwikiのとおり上書きしとる

32it/sから11it/sへの低下は痛すぎるな、ワイだけなのか とりあえず寝るわ

>>995 まぁ、寝てからやる方がスッキリするわよ

lud20250128122054caこのスレへの固定リンク: http://5chb.net/r/liveuranus/1674350145/

ヒント:5chスレのurlに http://xxxx.5chb.net/xxxx のようにbを入れるだけでここでスレ保存、閲覧できます。

TOPへ TOPへ

全掲示板一覧 この掲示板へ 人気スレ |

>50

>100

>200

>300

>500

>1000枚

新着画像

↓「なんJNVA部★135 ->画像>220枚 」を見た人も見ています:

・なんJNVA部★81

・なんJNVA部★87

・なんJNVA部★67

・なんJNVA部★71

・なんJNVA部★99

・なんJNVA部★74

・なんJNVA部★82

・なんJNVA部★86

・なんJNVA部★98

・なんJNVA部★64

・なんJNVA部★63

・なんJNVA部★76

・なんJNVA部★93

・なんJNVA部★97

・なんJNVA部★72

・なんJNVA部★83

・なんJNVA部★73

・なんJNVA部★77

・なんJNVA部★78

・なんJNVA部★75

・なんJNVA部★91

・なんJNVA部★70

・なんJNVA部★89

・なんJNVA部★84

・なんJNVA部★85

・なんJNVA部★69

・なんJnovelAI部

・なんJNVA部★92

・なんJNVA部★96

・なんJNVA部★94

・なんJNVA部★90

・なんJNVA部★88

・なんJNVA部★80

・なんJNVA部★79

・なんJNVA部★68

・なんJNVA部★65

・なんJNVA部★66

・なんJNVA部★120

・なんJNVA部★410

・なんJNVA部★130

・なんJNVA部★137

・なんJNVA部★444

・なんJNVA部★387

・なんJNVA部★384

・なんJNVA部★432

・なんJNVA部★495

・なんJNVA部★112

・なんJNVA部★160

・なんJNVA部★126

・なんJNVA部★440

・なんJNVA部★450

・なんJNVA部★104

・なんJNVA部★464

・なんJNVA部★510

・なんJNVA部★177

・なんJNVA部★118

・なんJNVA部★147

・なんJNVA部★209

・なんJNVA部★414

・なんJNVA部★388

・なんJNVA部★181

・なんJNVA部★418

・なんJNVA部★132

・なんJNVA部★385

01:36:40 up 27 days, 2:40, 0 users, load average: 14.14, 12.78, 12.00

in 2.6114678382874 sec

@2.6114678382874@0b7 on 020915

|